En programmation, le type str (pour string) est sans doute l’objet le plus utilisé dans l’écosystème Python. Qu’il s’agisse de traiter des logs de serveurs, de nettoyer des bases de données clients, de parser des fichiers JSON ou d’interagir avec des grands modèles de langage (LLM), le texte est partout. Pour un data engineer ou un développeur, maîtriser les chaînes de caractères ne se résume pas à savoir concaténer deux mots. Il s’agit de comprendre comment Python gère ces objets en mémoire, comment optimiser les opérations de transformation pour traiter des téraoctets de données, et comment sécuriser ces flux d’informations. Chez DATAROCKSTARS, nous considérons que la manipulation de texte est l’alphabet de la profession : une mauvaise gestion peut entraîner des corruptions de données, des failles de sécurité et des ralentissements critiques. Cet article propose une plongée technique profonde dans le str Python, conçu pour transformer votre pratique du code et renforcer votre maîtrise du patrimoine informationnel.

1. Nature et structure interne des objets str en Python

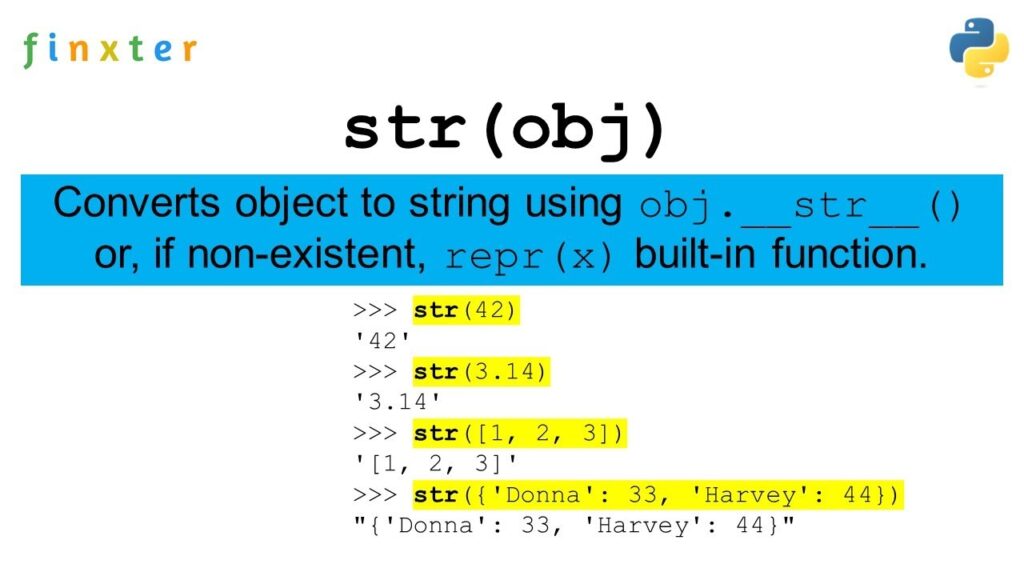

Un objet str en Python 3 est une séquence immuable de caractères Unicode. Contrairement à Python 2, où il existait une distinction floue entre les chaînes de bytes et les chaînes de caractères, Python 3 a normalisé le comportement : tout texte est par défaut traité comme de l’Unicode. Cela signifie que Python 3 peut gérer nativement n’importe quel alphabet, les emojis, et les symboles techniques sans configuration complexe. En coulisses, l’implémentation CPython gère ces objets de manière extrêmement optimisée. Python utilise une structure interne (souvent appelée PyUnicodeObject en C) qui s’adapte à la nature du texte : si votre chaîne ne contient que des caractères ASCII (standard 8 bits), Python optimisera le stockage pour ne consommer qu’un octet par caractère. Si vous utilisez des caractères complexes (comme des kanjis ou des caractères cyrilliques), il passera automatiquement à un encodage plus large (UCS-2 ou UCS-4).

Cette adaptabilité interne est une prouesse technique qui garantit que vos programmes sont à la fois économes en mémoire et internationalisés. Pour un développeur ou un data scientist, cela signifie que vous pouvez traiter des datasets mondiaux sans craindre des erreurs d’encodage massives. Chez DATAROCKSTARS, nous enseignons cette rigueur dès notre Bootcamp Data Scientist & AI. Comprendre que votre variable str n’est pas qu’un simple conteneur, mais un objet complexe géré intelligemment par l’interprète Python, est la première étape pour écrire du code de haut niveau, performant et portable sur vos infrastructures Cloud.

2. L’immuabilité et son importance cruciale pour la performance

L’immuabilité est une caractéristique fondamentale du str en Python. Cela signifie qu’une fois créé, un objet chaîne de caractères ne peut plus être modifié. Si vous effectuez une opération comme chaine + " ajout", vous ne modifiez pas la chaîne originale. À la place, Python crée un tout nouvel objet en mémoire qui contient le résultat de la concaténation. Pour les débutants, cela peut paraître inefficace. Pourquoi créer de nouveaux objets au lieu de modifier l’existant ? En réalité, cette conception est au cœur de la sécurité et de la robustesse de Python.

L’immuabilité permet aux chaînes d’être “hashables”, ce qui signifie qu’elles peuvent être utilisées comme clés dans des dictionnaires. Elle garantit également qu’une chaîne de caractères ne peut pas être altérée par erreur dans une fonction. Cependant, dans des contextes de data engineering intensif (par exemple, la construction d’un rapport de 10 Go par concaténations successives), l’immuabilité peut devenir une source de ralentissement critique. Si vous bouclez sur des millions de lignes pour concaténer des données, vous allez saturer la mémoire et déclencher le ramasse-miettes (garbage collector) inutilement. Les experts de DATAROCKSTARS apprennent aux ingénieurs à utiliser des méthodes comme .join() sur des listes, qui pré-allouent la mémoire nécessaire en une seule fois, évitant ainsi la création répétée d’objets intermédiaires. C’est ce type d’optimisation, enseigné dans notre Bootcamp Data Engineer & AIOps, qui fait la différence entre un script qui plante et un pipeline de production ultra-scalable.

3. Les différentes syntaxes de déclaration et leurs usages

Python offre une flexibilité syntaxique rare pour déclarer ses chaînes de caractères. Vous pouvez utiliser des guillemets simples ' ou doubles ". Il n’y a aucune différence technique entre les deux, mais la convention (PEP 8) suggère de choisir l’une et de s’y tenir. L’intérêt principal de cette dualité est d’éviter l’échappement excessif : si votre chaîne contient une apostrophe (ex: "L'informatique"), utiliser des guillemets doubles simplifie la lecture. Pour les textes longs, les sauts de ligne ou les blocs de documentation, les triples guillemets (''' or """) sont indispensables.

Une mention spéciale doit être faite pour les chaînes “raw” (brutes), notées avec un r devant (ex: r"C:\Users\nom\dossier"). Ces chaînes ignorent les séquences d’échappement (comme \n pour nouvelle ligne ou \t pour tabulation). Elles sont vitales lorsqu’on travaille avec des expressions régulières (Regex) ou des chemins de fichiers Windows, où le caractère backslash est omniprésent. Une confusion fréquente chez les débutants est de traiter un chemin Windows comme une chaîne classique, ce qui provoque des erreurs de parsing car \U or \t sont interprétés comme des caractères de contrôle. Savoir choisir la bonne syntaxe, c’est savoir écrire du code propre, lisible et surtout exempt de bugs d’interprétation. C’est un aspect maîtrisé dès le début dans notre formation en cybersécurité, où la manipulation correcte des chemins de fichiers et des inputs est critique.

4. Indexation et Slicing : La puissance du découpage séquentiel

Le slicing est sans doute la fonctionnalité la plus expressive et la plus utile de Python. Puisque les chaînes sont des séquences, vous pouvez accéder à n’importe quel caractère ou segment via une syntaxe basée sur les crochets []. L’indexation commence à 0, et Python supporte nativement les index négatifs (le -1 représente le dernier caractère, très pratique pour récupérer une extension de fichier). Le slicing permet d’extraire des sous-chaînes avec la syntaxe [début:fin:pas].

La puissance du slicing réside dans sa capacité à manipuler le texte comme un tableau de données. Par exemple, chaine[::-1] est le moyen idiomatique de renverser une chaîne. chaine[:10] permet de tronquer rapidement un texte pour l’affichage. Pour un Data Engineer formé chez DATAROCKSTARS, le slicing est l’outil de premier niveau pour le “data cleaning” rapide : extraire un code région dans un identifiant, supprimer des préfixes inutiles dans des logs, ou normaliser des formats de date. C’est une opération en temps constant qui ne nécessite aucune boucle complexe. En maîtrisant le slicing, vous réduisez la verbosité de votre code et augmentez sa lisibilité, une qualité recherchée dans tout code professionnel soumis à une revue par les pairs.

5. Méthodes de transformation : Le nettoyage de données à grande échelle

Un Data Engineer passe 80 % de son temps à nettoyer des données. Le type str en Python possède une bibliothèque de méthodes intégrées qui sont vos meilleures alliées. .strip(), .lstrip(), .rstrip() sont essentielles pour supprimer les espaces blancs indésirables en début ou fin de ligne, une erreur classique des exports CSV mal formés. Les méthodes .upper(), .lower(), .capitalize() and .title() permettent d’homogénéiser des données textuelles hétérogènes. Si vous fusionnez des bases de données issues de sources différentes, vous aurez toujours des variations de casse (ex: “PARIS” vs “Paris”).

Il existe aussi des méthodes plus avancées comme .replace(old, new) pour substituer des segments de texte, ou .split() and .rsplit() pour transformer une chaîne en une liste d’éléments. La méthode .splitlines() est particulièrement utile pour traiter des fichiers textes ligne par ligne. L’utilisation combinée de ces méthodes permet de construire des pipelines de transformation robustes. Chez DATAROCKSTARS, nous apprenons à nos étudiants à chaîner ces méthodes de manière élégante et efficace, en évitant les erreurs de type grâce à des vérifications préventives. Une bonne maîtrise de ces méthodes est ce qui permet de transformer une donnée brute, bruitée et incohérente, en un dataset exploitable pour des modèles d’intelligence artificielle.

6. Formatage moderne : L’hégémonie des f-strings

Pendant longtemps, Python a utilisé des méthodes comme % or .format(). Mais depuis Python 3.6, les f-strings (formatted string literals) sont devenues le standard absolu, et pour de bonnes raisons. Les f-strings permettent d’insérer des expressions Python directement à l’intérieur des chaînes de caractères en les préfixant avec f. C’est lisible, c’est puissant et c’est surtout plus rapide à l’exécution. Vous pouvez appeler des fonctions, effectuer des calculs ou formater des nombres (ex: f"{valeur:.2f}") directement dans la chaîne.

Pour un ingénieur, l’intérêt des f-strings va bien au-delà de l’affichage. Elles facilitent la construction dynamique de requêtes SQL, de chemins de fichiers, de logs d’erreurs ou de corps de messages destinés à des API. En utilisant des f-strings, vous rendez votre code plus facile à maintenir : vous voyez exactement quelle variable est injectée à quel endroit. Cependant, attention à ne jamais injecter des entrées utilisateur directement dans des f-strings destinées à des requêtes SQL sans utiliser des mécanismes de paramétrage (pour éviter les injections SQL). C’est un principe de base de notre formation en cybersécurité. Chez DATAROCKSTARS, nous encourageons l’utilisation des f-strings pour leur clarté, tout en enseignant les bonnes pratiques pour sécuriser ces injections dynamiques.

7. Encodage et Unicode : La gestion des données internationales

Travailler avec du texte en 2026, c’est travailler avec le monde entier. Le jeu de caractères ASCII, limité à 128 caractères, est une relique du passé. Unicode est le standard universel qui permet de représenter quasiment tous les caractères de toutes les langues, y compris les émojis et les symboles techniques. En Python, les chaînes de caractères sont des séquences de points de code Unicode. Mais lorsqu’il s’agit de stocker ces chaînes sur un disque ou de les envoyer sur le réseau, vous devez les transformer en une suite d’octets. C’est ce qu’on appelle l’encodage (la méthode .encode('utf-8')).

Le problème survient souvent lors de la lecture de données externes : vous recevez un fichier encodé en ‘latin-1’ ou en ‘cp1252’, et si vous essayez de le lire en ‘utf-8’, vous obtenez une UnicodeDecodeError. Pour tout professionnel de la data, savoir diagnostiquer et corriger ces erreurs est un passage obligé. Il faut comprendre la différence entre bytes and str. Les bytes sont des données binaires brutes (ce qui est sur le disque), alors que les str sont des caractères (ce que vous manipulez dans votre code). Chez DATAROCKSTARS, nous expliquons ce cycle de vie des données pour vous éviter les erreurs de lecture catastrophiques dans vos pipelines de production. Une bonne gestion des encodages est le signe d’un ingénieur qui travaille sur des systèmes distribués réels.

8. Expressions régulières et Regex : L’outil de précision pour le Data Engineer

Si les méthodes intégrées aux strings ne suffisent pas, les expressions régulières (Regex) sont la solution. Grâce au module re de Python, vous pouvez définir des motifs textuels complexes et les chercher, les remplacer ou les extraire dans n’importe quel texte. Besoin d’extraire toutes les adresses email d’un corpus de 50 000 documents ? Regex est là. Besoin de nettoyer tous les numéros de téléphone formatés différemment ? Regex est là.

Les Regex sont un langage à part entière, réputé pour être complexe et parfois difficile à lire, mais d’une efficacité redoutable pour la structuration de données non structurées. Apprendre les Regex, c’est comme apprendre à manipuler un scalpel. Vous pouvez faire des opérations chirurgicales sur du texte massif. Cependant, attention à la performance : une mauvaise Regex peut entraîner des temps de calcul exponentiels (ReDoS – Regular Expression Denial of Service). C’est un risque de sécurité important que nous traitons dans notre formation cybersécurité en ligne. Chez DATAROCKSTARS, nous enseignons les Regex avec prudence : écrivez-les pour qu’elles soient simples, documentées et testées. Une Regex mal maîtrisée est un bug en puissance, mais une Regex maîtrisée est un super-pouvoir pour tout Data Engineer.

9. Le rôle crucial des strings dans le Natural Language Processing (NLP)

Le traitement du langage naturel (NLP) est l’un des domaines les plus stimulants de l’intelligence artificielle actuelle. Et au cœur du NLP, il y a la chaîne de caractères. Avant de nourrir un modèle avec du texte, vous devez passer par une étape appelée la tokenisation. C’est ici que votre expertise du str Python est mise à l’épreuve. Il faut transformer vos chaînes en unités plus petites : des mots, des sub-words (sous-mots) ou des caractères. Ce processus de tokenisation repose entièrement sur les manipulations de str.

Dans nos cursus, notamment le Bootcamp Data Scientist & AI, nous explorons comment les méthodes de str sont utilisées pour le nettoyage avant tokenisation : suppression de la ponctuation, mise en minuscule, normalisation des caractères accentués, décomposition des caractères spéciaux. Ce n’est pas juste de la théorie ; c’est ce qui définit la qualité de votre dataset d’entraînement. Si votre tokenisation est mauvaise, votre modèle d’IA sera médiocre, peu importe sa complexité. Comprendre le str au niveau des octets et des caractères est indispensable pour concevoir des systèmes de NLP performants qui ne “cassent” pas les données multilingues.

10. Vers l’avenir : Les strings dans les workflows d’agents IA

L’évolution des LLM vers des agents autonomes change notre usage des chaînes de caractères. Aujourd’hui, on ne traite plus seulement du texte statique ; on traite des flux de texte qui sont les vecteurs de communication des agents IA. Lorsqu’un agent doit exécuter une action, il génère du texte structuré (souvent du JSON ou du XML). Votre rôle, en tant qu’ingénieur, est de garantir que ce texte généré est parfaitement conforme aux attentes de vos systèmes en aval.

On assiste à l’émergence de frameworks de “Structured Output” (comme Pydantic en Python) qui permettent de valider automatiquement que le str généré par une IA correspond bien à un schéma attendu. C’est l’avenir du développement : une symbiose où l’IA génère des chaînes de caractères complexes, et votre code Python les valide, les parse et les exécute. Chez DATAROCKSTARS, nous préparons nos étudiants à ce monde. Vous ne serez pas juste des codeurs, vous serez des architectes de chaînes de confiance, garantissant que le texte produit par l’IA est robuste, sécurisé et prêt à l’emploi. Le str Python est le pont entre l’intelligence pure de l’IA et l’exécution concrète sur vos infrastructures Cloud.

En maîtrisant ces fondamentaux et ces techniques avancées, vous ne vous contentez pas d’apprendre un type de donnée ; vous vous appropriez la matière première de la révolution numérique. La compétence de manipulation de données textuelles est ce qui transforme un simple utilisateur de Python en un ingénieur capable de bâtir les systèmes de demain. Chez DATAROCKSTARS, nous sommes là pour transformer ce potentiel en expertise concrète. Rejoignez notre communauté de passionnés, suivez nos formations et apprenez à transformer le chaos du texte brut en une intelligence structurée et performante. Souhaitez-vous découvrir comment notre Bootcamp Data Engineer & AIOps peut vous propulser au rang des meilleurs architectes de données ?

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !