Un workflow (ou flux de travail) est une suite de tâches logiques et ordonnées permettant d’accomplir un objectif spécifique. Qu’il s’agisse de valider une facture, de déployer un modèle d’IA ou de nettoyer un dataset, le workflow transforme un chaos d’actions isolées en un processus fluide, reproductible et mesurable. Dans l’ère de l’intelligence artificielle et du Big Data, la capacité à concevoir des workflows robustes est ce qui sépare les entreprises agiles des organisations sclérosées. Chez DATAROCKSTARS, nous enseignons que le workflow est la “partition de musique” de l’ingénieur : il définit qui fait quoi, quand, et avec quels outils, garantissant ainsi une qualité constante et une automatisation sans faille.

1. Qu’est-ce qu’un workflow réellement ?

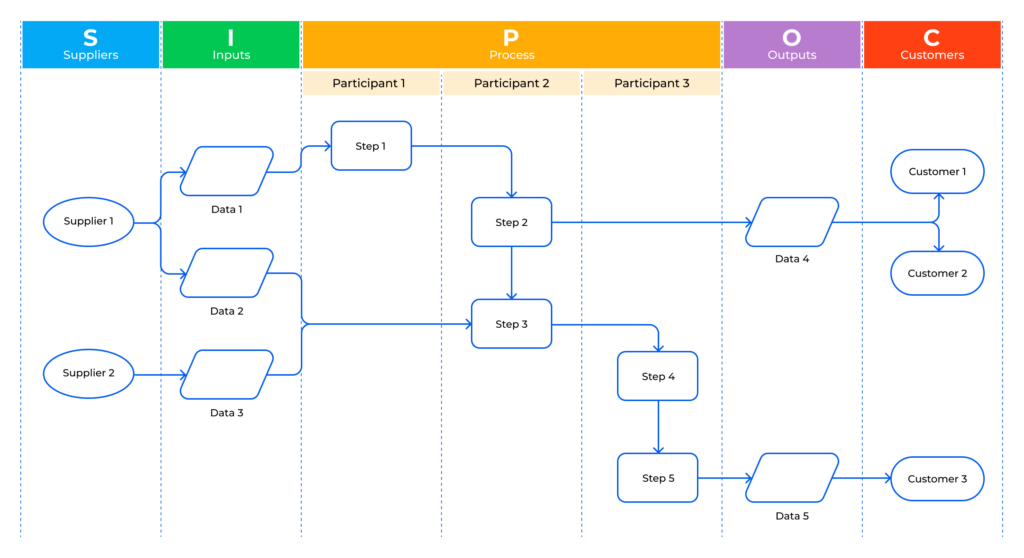

Fondamentalement, un workflow est une représentation visuelle ou logique d’un processus métier. Il se compose de trois éléments clés : les entrées (inputs), les transformations (étapes de calcul ou d’action) et les sorties (outputs). Il permet de s’assurer que chaque étape est validée avant de passer à la suivante, réduisant ainsi drastiquement les erreurs humaines.

Pour un professionnel de la donnée, un workflow est un contrat d’exécution. Chez DATAROCKSTARS, nous apprenons à nos étudiants à cartographier ces flux avant même d’écrire la première ligne de code. Une mauvaise conception de départ mène inévitablement à des goulots d’étranglement ou à des pertes de données critiques en production.

2. Les Workflows de Données (Data Pipelines)

En Data Engineering, le workflow prend souvent la forme d’un pipeline ETL (Extract, Transform, Load). Il s’agit d’extraire des données de diverses sources, de les nettoyer et de les charger dans un entrepôt de données. Ces workflows doivent être capables de gérer des échecs (retries) et de garantir l’intégrité des données à chaque étape.

La maîtrise de ces flux est le cœur de notre Bootcamp Data Engineer & AIOps. Vous y apprendrez à utiliser des orchestrateurs comme Apache Airflow ou AWS Glue pour automatiser ces tâches répétitives, permettant à vos systèmes de fonctionner 24h/24 sans intervention manuelle constante.

3. Les Workflows d’IA et de Machine Learning (MLOps)

L’entraînement d’un modèle d’IA n’est pas une action unique, c’est un workflow itératif. Il commence par l’acquisition des données, passe par le feature engineering, l’entraînement, l’évaluation, et se termine par le déploiement et le monitoring. Si une étape échoue ou si les performances chutent, le workflow doit pouvoir se relancer automatiquement.

Ce cycle de vie est ce que nous appelons le MLOps. Chez DATAROCKSTARS, nous formons nos étudiants à automatiser ces “chaînes de production de l’intelligence” pour garantir que les modèles restent précis et performants dans le temps, malgré l’évolution des données du monde réel.

4. L’automatisation des Workflows Métier (BPA)

Au-delà de la technique pure, les workflows transforment le quotidien des départements RH, Marketing ou Finance. L’automatisation des processus métier (Business Process Automation) permet de supprimer les tâches à faible valeur ajoutée, comme la saisie manuelle de données ou l’envoi d’emails de relance.

L’objectif est de libérer du temps pour la créativité et la stratégie. Dans nos cursus Data Analyst, nous montrons comment utiliser des outils comme Zapier ou Make pour connecter des applications entre elles et créer des workflows intelligents qui réagissent en temps réel aux événements business.

5. Les Workflows de Collaboration (GitFlow)

Dans le développement logiciel, le workflow définit comment les équipes collaborent sur le code. Le “GitFlow” est un modèle de gestion de branches qui permet à plusieurs développeurs de travailler sur des fonctionnalités différentes sans casser la version principale du logiciel.

Cette discipline est essentielle pour la stabilité des projets. Chez DATAROCKSTARS, nous imposons ces standards de collaboration dès le premier jour. Savoir gérer ses “Pull Requests” et ses fusions de branches au sein d’un workflow structuré est une compétence de savoir-être technique (hard-soft skill) indispensable en entreprise.

6. Les Workflows d’IA Générative et Agents IA

Le futur des workflows réside dans l’orchestration d’agents IA. Au lieu d’un script rigide, vous concevez un workflow où différents LLM collaborent : l’un cherche l’information (RAG), l’autre l’analyse, et le troisième rédige le rapport final. C’est l’ère des workflows dynamiques et autonomes.

Maîtriser cette orchestration est la compétence d’élite de 2026. Chez DATAROCKSTARS, nous vous apprenons à construire ces chaînes de décision complexes avec des frameworks comme LangGraph ou CrewAI, transformant l’IA d’un simple gadget de chat en un véritable moteur de production industrielle.

7. L’Orchestration : Le chef d’orchestre des workflows

Un workflow complexe nécessite un orchestrateur. C’est l’outil qui surveille l’exécution de chaque tâche, gère les dépendances (la tâche B ne commence que si la tâche A réussit) et envoie des alertes en cas d’erreur. C’est la tour de contrôle de votre infrastructure.

Nous formons nos ingénieurs à maîtriser ces outils d’orchestration cloud-native (Kubernetes, Airflow, Step Functions). Un workflow sans orchestration est une bombe à retardement technique. Chez DATAROCKSTARS, la fiabilité et la résilience sont les maîtres-mots de notre approche de l’ingénierie.

8. Monitoring et Observabilité des Workflows

Concevoir un workflow ne suffit pas ; il faut pouvoir mesurer son efficacité. Combien de temps prend chaque étape ? Où sont les ralentissements ? Quel est le taux d’erreur ? L’observabilité permet d’identifier les inefficacités et d’optimiser le flux en continu.

Dans nos bootcamps, nous apprenons à intégrer du logging et du monitoring dès la conception. Un workflow transparent est un workflow facile à améliorer. Cette culture de la donnée appliquée aux processus eux-mêmes est ce qui fait de vous un expert capable de justifier chaque optimisation auprès de sa direction.

9. Gouvernance et Sécurité des flux

Chaque étape d’un workflow est un point d’entrée potentiel pour une faille de sécurité ou une erreur de conformité (RGPD). Sécuriser les workflows signifie contrôler qui a accès aux données à chaque étape et s’assurer que les flux d’information sont chiffrés et audités.

La sécurité n’est pas une option, c’est une composante du design. Dans notre formation en cybersécurité, nous détaillons comment protéger vos pipelines automatisés contre les injections de code ou les fuites de données. Un workflow performant doit avant tout être un workflow sûr.

10. Pourquoi devenir un maître des workflows avec DATAROCKSTARS

Les entreprises ne cherchent plus seulement des gens qui savent coder, elles cherchent des gens qui savent organiser la complexité. Maîtriser les workflows, c’est posséder la vision d’architecte nécessaire pour transformer une idée en une solution industrielle scalable.

Chez DATAROCKSTARS, nous vous donnons cette hauteur de vue. Nos cursus intensifs vous plongent dans la réalité des flux de travail modernes, vous préparant à devenir les leaders techniques de demain. Prêt à mettre de l’ordre dans le chaos et à propulser votre carrière ? Souhaitez-vous découvrir comment notre Bootcamp Data Engineer & AIOps peut vous aider à devenir un expert en orchestration de workflows ?

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !