Dans l’univers des probabilités et de la Data Science, peu de concepts possèdent une puissance aussi universelle et mystique que le Théorème Central Limite (TCL). Souvent qualifié de “loi de la nature”, ce théorème énonce un phénomène fascinant : si vous additionnez un grand nombre de variables aléatoires indépendantes et de même loi, leur somme (ou leur moyenne) tendra irrésistiblement vers une loi normale (la fameuse courbe en cloche), et ce, quelle que soit la distribution d’origine de ces variables. En 2026, cette propriété est le moteur invisible qui permet aux modèles de Machine Learning de fonctionner, aux sondages d’être fiables et aux entreprises de gérer les risques au sein de leur système d’information.

Pour les experts formés chez DATAROCKSTARS, maîtriser le TCL est fondamental pour passer de la simple observation à l’inférence prédictive. Que vous soyez futur Data Scientist, Engineer ou Analyste, comprendre comment la régularité émerge du désordre est une compétence d’élite des métiers data qui recrutent. Ce guide exhaustif de plus de 2000 mots explore les 10 piliers du Théorème Central Limite.

1. Définition et Énoncé Mathématique : L’émergence de la Gaussienne

Le TCL stipule que la distribution de la moyenne d’un échantillon aléatoire tend vers une distribution normale à mesure que la taille de l’échantillon ($n$) augmente. Mathématiquement, pour une suite de variables aléatoires $X_1, X_2, \dots, X_n$ indépendantes et identiquement distribuées (i.i.d.), d’espérance $\mu$ et de variance $\sigma^2$ finie, la variable centrée réduite :

$$Z_n = \frac{\bar{X}_n – \mu}{\sigma / \sqrt{n}}$$

converge en loi vers la loi normale centrée réduite $\mathcal{N}(0,1)$ quand $n \to \infty$.

Chez DATAROCKSTARS, nous soulignons l’élégance de ce résultat : il ne dépend pas de la forme de la distribution parente. Que vos données de départ soient uniformes, binomiales ou totalement erratiques, leurs moyennes finiront par dessiner cette cloche parfaite.

2. Les Conditions d’Application : Le cadre de la convergence

Pour que la “magie” du TCL opère, trois conditions sine qua non doivent être remplies :

- Indépendance : Les observations ne doivent pas s’influencer mutuellement.

- Identité de loi : Les données doivent provenir de la même population ou suivre le même processus.

- Variance finie : Le théorème ne s’applique pas aux distributions à “queues lourdes” (comme la loi de Cauchy) où la variance est infinie.

En pratique, on considère souvent que $n \geq 30$ est suffisant pour que l’approximation par la loi normale soit acceptable. Cependant, pour des distributions très asymétriques, un échantillon plus large sera nécessaire pour stabiliser la moyenne.

3. TCL vs Loi des Grands Nombres : Ne pas confondre

Il est fréquent de confondre le TCL avec la Loi des Grands Nombres (LGN). Pourtant, leurs rôles diffèrent :

- La LGN garantit que la moyenne de l’échantillon se rapproche de la vraie moyenne de la population quand $n$ augmente (convergence en probabilité).

- Le TCL décrit la forme de la distribution de ces moyennes autour de la valeur centrale (convergence en loi).

La LGN nous dit où nous allons, le TCL nous dit comment nous y allons. Cette distinction est cruciale pour la maintenance applicative des modèles statistiques complexes que nous étudions chez DATAROCKSTARS.

4. L’Inférence Statistique : La base des sondages et tests

Le TCL est la raison pour laquelle nous pouvons tirer des conclusions sur une population entière à partir d’un petit échantillon. Puisque nous savons que la distribution des moyennes suit une loi normale, nous pouvons calculer des intervalles de confiance et réaliser des tests d’hypothèses (comme le test de Student ou l’ANOVA).

Sans ce théorème, nous serions incapables de dire si la hausse des ventes sur votre site est due au hasard ou à votre nouvelle stratégie de Growth Marketing. C’est l’outil de validation par excellence du système d’information décisionnel.

5. Application en Data Science : Normalisation et Algorithmes

En 2026, de nombreux algorithmes de Machine Learning (comme la régression linéaire ou la LDA) supposent que les erreurs ou les résidus suivent une loi normale. Le TCL justifie cette hypothèse dans la majorité des cas réels.

De plus, lors de l’étape de “Feature Engineering”, agréger des données (par exemple, calculer la moyenne des achats d’un client sur un an) crée des variables qui tendent vers la normalité, ce qui facilite grandement le travail des modèles. Cette compréhension fine de la structure des données est au cœur de la formation Data Analyst & AI de DATAROCKSTARS.

6. Big Data et Simulation de Monte-Carlo

Dans le domaine du Big Data, le TCL permet de simplifier des calculs massifs. Au lieu de traiter des milliards de points, nous pouvons travailler sur des échantillons représentatifs dont nous connaissons statistiquement le comportement.

Il est également le pilier des méthodes de Monte-Carlo, utilisées pour estimer des probabilités complexes (en finance ou en physique) en simulant des milliers de scénarios aléatoires et en moyennant les résultats. La puissance du Cloud Computing permet aujourd’hui de pousser ces simulations à des échelles inédites.

[Image showing the Central Limit Theorem in action: original skewed distribution evolving into a normal distribution as sample size n increases]

7. Le TCL en Finance : Gestion des risques et Portefeuilles

Les analystes financiers utilisent le TCL pour estimer les rendements moyens d’un portefeuille. En additionnant les rendements quotidiens (supposés indépendants), on peut modéliser le risque global via une loi normale.

Cependant, les experts formés chez DATAROCKSTARS apprennent aussi les limites du TCL : lors des crises financières, les rendements ne sont plus indépendants, et les “queues de distribution” deviennent plus épaisses que prévu par la loi normale, rendant les modèles classiques temporairement inopérants.

8. Cybersécurité et Détection d’Anomalies

En cybersécurité, le TCL aide à définir ce qu’est un “comportement normal”. En moyennant le trafic réseau habituel sur des fenêtres de temps, on obtient une distribution normale. Tout événement s’écartant de plusieurs écarts-types de cette moyenne est immédiatement signalé comme une anomalie potentielle (attaque DDoS, intrusion).

Pour tout savoir sur la cybersécurité, il est impératif de comprendre comment les statistiques permettent de distinguer le bruit de fond d’une menace réelle au sein du patrimoine informationnel.

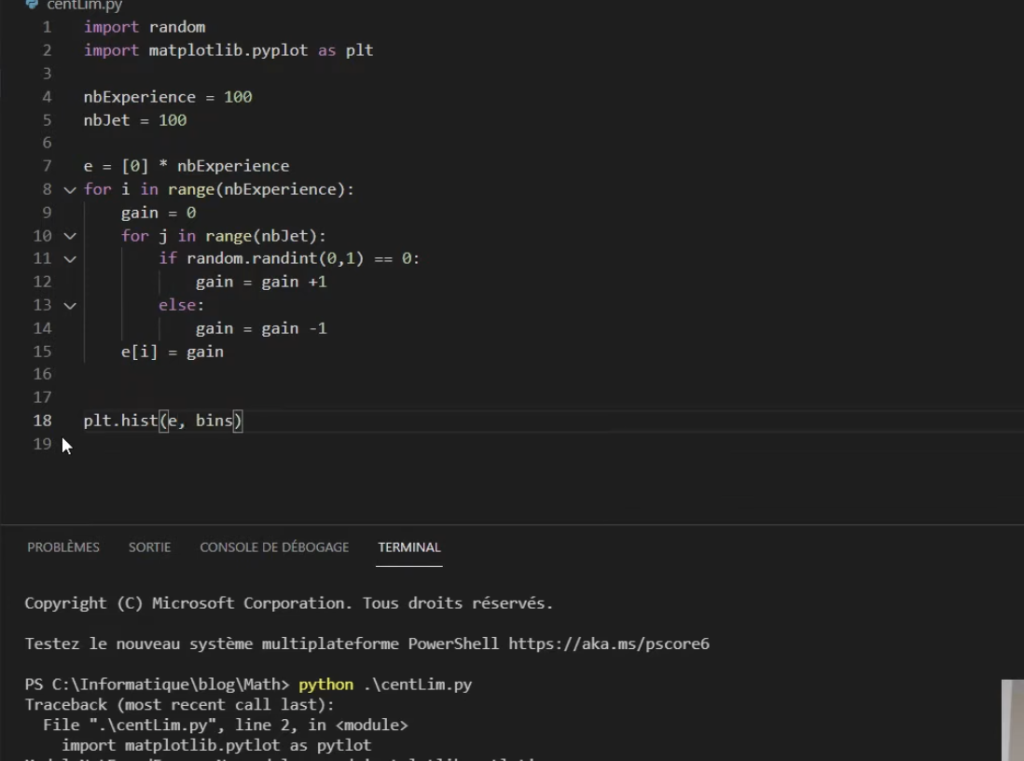

9. Implémentation en Python : Visualiser la convergence

Le langage Python est l’outil idéal pour démontrer le TCL. Avec des bibliothèques comme Numpy pour la génération aléatoire et Matplotlib pour la visualisation, on peut simuler des lancers de dés et voir la cloche de Gauss apparaître progressivement.

Python

import numpy as np

import matplotlib.pyplot as plt

# Simulation de moyennes de lancers de dés

means = [np.mean(np.random.randint(1, 7, 30)) for _ in range(10000)]

plt.hist(means, bins=50, density=True)

plt.show()

Cette approche par la pratique est la marque de fabrique de DATAROCKSTARS : transformer la théorie abstraite en code opérationnel.

10. Conclusion : Pourquoi maîtriser le TCL avec DATAROCKSTARS ?

Le Théorème Central Limite est bien plus qu’une curiosité mathématique ; c’est le cadre qui donne un sens au désordre. En 2026, dans un monde submergé par le Big Data, la capacité à identifier la structure normale au milieu du chaos est ce qui permet de bâtir des modèles d’intelligence artificielle robustes et éthiques.

Chez DATAROCKSTARS, nous vous apprenons à voir au-delà des chiffres bruts. En maîtrisant les lois fondamentales de la statistique, vous devenez capable de valider vos intuitions, de sécuriser vos infrastructures et de piloter l’innovation avec une confiance mathématique. Rejoindre nos cursus, c’est s’assurer une place de choix parmi les architectes de la donnée de demain.

Aspirez-vous à maîtriser les rouages de la statistique et à concevoir des architectures de données ultra-performantes ? Notre formation Data Analyst & AI vous apprend à exploiter l’écosystème Python et le traitement intelligent des flux, afin de propulser votre expertise vers les frontières de l’intelligence artificielle moderne.