Dans le panorama de la vision par ordinateur en 2026, un acronyme domine les débats par sa vitesse et son efficacité : YOLO (You Only Look Once). Contrairement aux méthodes traditionnelles qui scannent une image plusieurs fois pour identifier des objets, YOLO traite l’intégralité d’une scène en un seul passage de réseau de neurones. Cette prouesse technique permet d’atteindre des cadences de traitement dépassant les 100 images par seconde, rendant possible l’analyse instantanée de flux vidéo haute définition sur des équipements parfois très modestes.

Pour un professionnel de l’IA ou de la robotique, comprendre YOLO est devenu indispensable. En 2026, l’enjeu n’est plus seulement de reconnaître une forme, mais de le faire avec une latence quasi nulle pour permettre des décisions critiques. Que ce soit pour la voiture autonome, la surveillance intelligente ou le tri industriel automatisé, YOLO est l’outil qui transforme une caméra passive en un capteur intelligent capable de comprendre son environnement avec une précision chirurgicale.

2. Définition et fondements techniques du concept

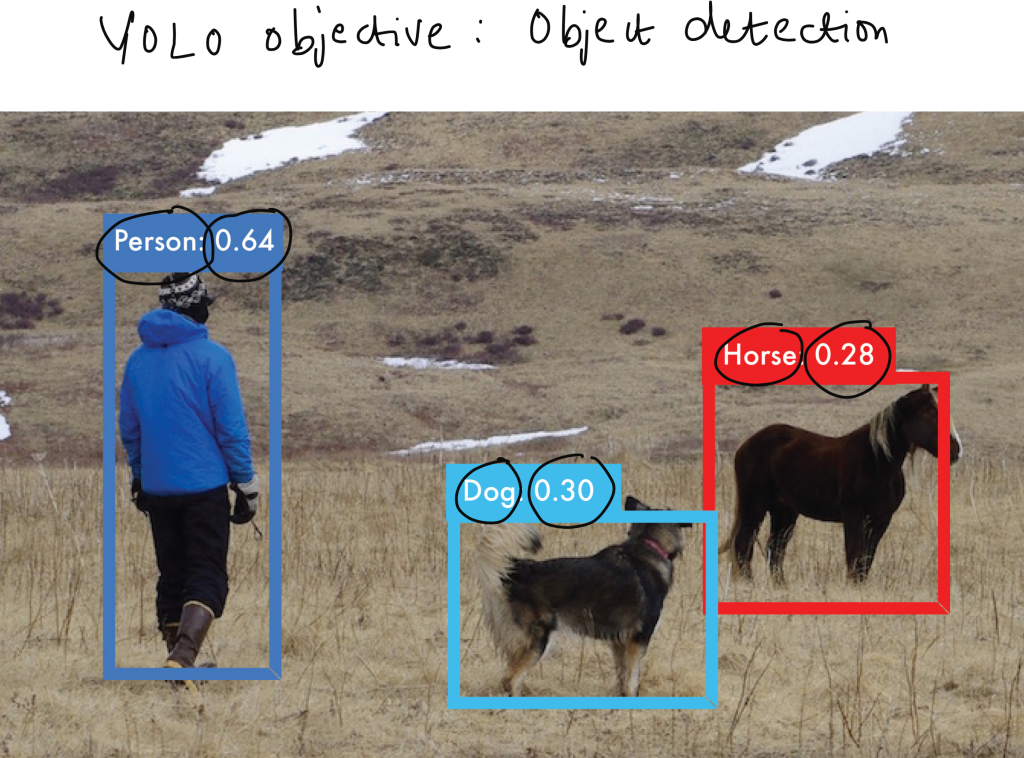

Pour vulgariser YOLO, imaginez que vous cherchez vos clés dans une pièce. Une méthode classique consisterait à regarder chaque meuble l’un après l’autre (fenêtrage glissant). Avec YOLO, vous ouvrez les yeux, vous prenez une “photo mentale” globale de la pièce, et votre cerveau identifie instantanément la position de tous les objets (clés, portefeuille, téléphone) en une fraction de seconde. C’est cette vision globale qui fait la force de l’algorithme : il analyse le contexte entier de l’image pour éviter les faux positifs.

Techniquement, YOLO divise l’image en une grille de cellules ($S \times S$). Chaque cellule est responsable de la prédiction de “boîtes de délimitation” (Bounding Boxes) et des scores de confiance pour les objets dont le centre tombe dans cette cellule. L’algorithme prédit simultanément plusieurs boîtes et les probabilités de classes pour ces boîtes. En 2026, les versions récentes (comme YOLOv11 ou v12) utilisent des architectures de type “backbone” ultra-optimisées qui réduisent drastiquement le nombre de paramètres tout en augmentant la précision.

L’implémentation de YOLO repose massivement sur le langage de programmation Python et des frameworks comme PyTorch ou ONNX. Pour les déploiements en production, on utilise souvent Docker pour isoler l’environnement de calcul, garantissant que les dépendances CUDA (pour le calcul GPU) restent stables. Cette architecture permet une maintenance applicative fluide, facilitant la mise à jour des modèles sans interrompre les services de surveillance ou de production.

3. À quoi sert ce domaine dans le monde professionnel ?

YOLO est le moteur de l’autonomie moderne. Dans le secteur de la Logistique, il révolutionne la gestion des entrepôts. Exemple concret : Des entreprises comme Amazon utilisent YOLO sur des drones ou des robots mobiles pour scanner les codes-barres et identifier les produits sur les étagères en mouvement. L’algorithme permet de compter les stocks en temps réel avec une fiabilité de 99,9 %, éliminant les inventaires manuels fastidieux.

Dans le domaine de la Santé, YOLO assiste les praticiens lors des interventions. Cas d’usage technologique : Lors de chirurgies assistées par ordinateur, YOLO est utilisé pour identifier et suivre en temps réel les instruments chirurgicaux et les structures anatomiques critiques sur le flux vidéo de l’endoscope. Cela permet d’alerter le chirurgien s’il s’approche d’une zone à risque, intégrant ainsi une couche de sécurité active basée sur la Data Science appliquée.

Pour la Cybersécurité physique, YOLO transforme la vidéosurveillance. Exemple en entreprise : Un site industriel sensible utilise YOLO pour détecter automatiquement le port des équipements de protection individuelle (EPI) comme les casques ou les gilets réfléchissants. Si un intrus ou une anomalie (départ de feu, fuite de liquide) est repéré, le système déclenche une alerte immédiate. C’est un complément indispensable pour tout savoir sur la cybersécurité globale d’une infrastructure d’importance vitale.

4. Classement des 10 points clés ou composants essentiels en 2026

- Le Backbone : Le réseau de neurones principal (souvent un CSPDarknet) qui extrait les caractéristiques de l’image.

- Le Neck : La partie qui combine les caractéristiques à différentes échelles pour détecter des objets de toutes tailles.

- Le Head : La couche finale qui effectue les prédictions des boîtes de délimitation et des classes.

- Anchor Boxes : Des modèles de boîtes prédéfinis qui aident l’algorithme à mieux cadrer les objets.

- Non-Maximum Suppression (NMS) : La technique de nettoyage qui élimine les boîtes redondantes pour ne garder que la meilleure.

- Loss Function : Le calcul mathématique qui permet au modèle d’apprendre de ses erreurs pendant l’entraînement.

- Real-time Performance : La capacité à traiter plus de 30 images par seconde (FPS) sur du matériel standard.

- Transfer Learning : Réutiliser un modèle déjà entraîné sur des millions d’images pour le spécialiser sur un besoin précis.

- Quantization : Réduire la taille du modèle pour qu’il puisse tourner sur des puces mobiles (Edge AI).

- Data Augmentation : Créer des variantes des images d’entraînement (rotation, luminosité) pour rendre le modèle plus robuste.

5. Guide de choix selon votre projet professionnel

L’utilisation de YOLO varie selon que vous travaillez sur des prototypes de recherche ou des systèmes industriels embarqués.

| Profil | Stratégie recommandée | Outils à privilégier | Objectif métier |

| Étudiant | Découverte des bases de la Vision | YOLOv8/v10, OpenCV | Créer un projet de détection simple |

| Reconversion | Focus sur l’intégration logicielle | Python, Flask, Power Automate | Devenir Développeur Vision Junior |

| Expert IT | Optimisation pour l’Edge Computing | TensorRT, ONNX, C++ | Architecte de systèmes embarqués IA |

| Data Scientist | Entraînement sur données massives | PyTorch, Cloud Computing GCP/AWS | Expert en Deep Learning appliqué |

Pour ceux qui souhaitent accélérer leur carrière, les bootcamps intensifs en IA et Data sont essentiels pour maîtriser le pipeline complet : de l’annotation des données au déploiement du modèle. Exemple technologique : Apprendre à entraîner YOLO sur un jeu de données personnalisé de 10 000 images pour détecter des défauts de soudure sur une ligne de production est une compétence rare et extrêmement prisée en 2026.

6. L’impact de l’intelligence artificielle sur YOLO

En 2026, YOLO a bénéficié de l’explosion de l’intelligence artificielle générative. Cas technologique : On utilise désormais l’IA générative pour créer des “données synthétiques” afin d’entraîner YOLO. Si une entreprise doit détecter des accidents de voiture rares, elle peut générer 50 000 images réalistes d’accidents sous différents angles et météos. Cela permet d’obtenir un modèle ultra-performant sans avoir besoin d’attendre que des accidents réels se produisent pour collecter des données.

En entreprise, l’IA facilite aussi l’auto-étiquetage. Exemple en entreprise : Pour entraîner un modèle de détection de nuisibles dans l’agriculture, un modèle de fond très puissant (Foundation Model) peut pré-annoter des millions d’images. YOLO est ensuite entraîné sur ces données pour devenir un modèle “distillé”, beaucoup plus léger et rapide, capable de tourner directement sur le processeur d’un tracteur autonome.

Enfin, l’IA améliore la maintenance applicative des modèles YOLO. Des systèmes de “monitoring de dérive” (Drift Detection) surveillent si les performances du modèle baissent à cause d’un changement d’environnement (ex: nouvelle caméra, changement d’éclairage en usine). Si une baisse est détectée, le système lance automatiquement un réentraînement sur les nouvelles données, garantissant une fiabilité constante du système de vision sans intervention humaine.

7. Comprendre les paradigmes et concepts avancés

Un concept fondamental de YOLO est la distinction entre One-Stage et Two-Stage detectors. YOLO est un “One-Stage”, ce qui signifie qu’il prédit les coordonnées et les classes en une seule étape. Exemple technologique : Contrairement à Faster R-CNN (Two-Stage) qui est plus précis mais beaucoup plus lent, YOLO privilégie la vitesse. En 2026, l’écart de précision s’est réduit à tel point que YOLO est devenu le standard par défaut pour 90 % des applications industrielles.

Un autre paradigme avancé est l’IoU (Intersection over Union). C’est la métrique qui permet d’évaluer si la boîte prédite par YOLO correspond bien à la boîte réelle (Ground Truth). Si l’IoU est supérieur à 0.5, on considère souvent que la détection est correcte. C’est grâce à cette rigueur mathématique que l’on peut valider la sécurité d’un chariot élévateur autonome : il doit détecter un piéton avec un score IoU très élevé pour déclencher l’arrêt d’urgence.

Enfin, l’intégration de YOLO dans des architectures de Cloud Computing pour le traitement massif permet de centraliser l’intelligence. On peut imaginer 1000 caméras de ville envoyant leurs flux vers un cluster de serveurs où YOLO analyse le trafic, détecte les stationnements interdits et identifie les départs d’incendie simultanément. Cette centralisation, souvent gérée via des micro-services isolés, offre une puissance d’analyse urbaine sans précédent.

8. L’évolution historique : de la recherche à l’industrie 4.0

L’histoire de YOLO est marquée par une accélération phénoménale de l’innovation :

- 2015 : Joseph Redmon publie le premier papier YOLO, révolutionnant la détection d’objets en abandonnant le fenêtrage glissant.

- 2018 : YOLOv3 introduit les prédictions multi-échelles, améliorant grandement la détection des petits objets.

- 2020 : YOLOv4 et v5 marquent le passage à une utilisation industrielle massive avec des implémentations PyTorch très accessibles.

- 2023-2025 : Les versions v8 à v10 intègrent des transformeurs (architectures de type attention) pour une précision record.

- 2026 : YOLO devient “multimodal” et autonome, capable d’apprendre de nouveaux objets avec seulement quelques exemples (Few-shot learning) tout en consommant 50 % d’énergie en moins.

9. Idées reçues, limites et défis techniques

L’idée reçue la plus courante est que “YOLO peut tout voir”. C’est faux. L’algorithme a toujours des difficultés avec les objets très denses ou se chevauchant (comme une foule compacte vus de loin). Le défi technique réside dans la résolution de l’image d’entrée : si l’objet est trop petit par rapport à la grille initiale, YOLO peut passer à côté. C’est pourquoi le choix du matériel et de l’optique reste primordial.

Une limite réelle est le biais des données. Exemple en entreprise : Si un modèle YOLO de détection de défauts est entraîné uniquement sur des pièces en métal brillant, il échouera lamentablement sur des pièces mates. La qualité de la Data Science en amont est le seul rempart contre ces échecs. Il faut garantir une diversité de données exemplaire pour éviter des erreurs qui pourraient coûter cher en chaîne de production.

Enfin, la cybersécurité des modèles est un défi émergent en 2026. Des “attaques adverses” (Adversarial Attacks) permettent de tromper YOLO en ajoutant un motif invisible à l’œil humain sur un objet pour le rendre indétectable par l’IA. Cas concret : Un pirate pourrait porter un t-shirt avec un motif spécifique pour devenir invisible aux yeux des caméras de sécurité basées sur YOLO. La sécurisation des modèles contre ces manipulations est la nouvelle frontière de la vision par ordinateur.

10. Conclusion et perspectives d’avenir

YOLO en 2026 est bien plus qu’un algorithme ; c’est l’œil de l’intelligence artificielle. En alliant une vitesse fulgurante à une précision toujours croissante, il a permis de débloquer des usages que l’on pensait réservés à la science-fiction il y a encore dix ans. De la voiture autonome à la chirurgie augmentée, YOLO apporte la réactivité nécessaire pour que l’IA puisse interagir avec le monde physique de manière sûre et efficace.

L’avenir se dessine vers une intégration totale dans nos objets du quotidien grâce à l’Edge AI. Bientôt, nos lunettes connectées ou nos appareils ménagers intégreront des versions miniatures de YOLO pour nous assister en temps réel. Maîtriser YOLO aujourd’hui, c’est s’assurer de comprendre et de bâtir les interfaces visuelles de demain, où chaque caméra devient une source de compréhension et de décision.

Êtes-vous prêt à exceller en tant que Data Engineer ? Notre formation vous apprend à maîtriser les défis de l’ingénierie des données, en renforçant la collaboration et en optimisant les processus de gestion de données pour des projets plus efficaces et innovants.

Merci pour votre lecture ! Si vous souhaitez lire nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié lorsqu’un nouvel article est publié !