Dans l’univers du Traitement du Langage Naturel (NLP), le défi majeur est de permettre aux machines de “comprendre” le sens des mots. Un ordinateur ne manipule pas des concepts, il manipule des nombres. Le TF-IDF (Term Frequency-Inverse Document Frequency) est l’une des techniques de vectorisation les plus robustes et les plus utilisées pour transformer du texte brut en données numériques exploitables par des algorithmes. Il ne se contente pas de compter les mots ; il les pondère en fonction de leur importance réelle dans un document par rapport à l’ensemble d’un corpus. Pour un ingénieur spécialisé en IA formé chez DATAROCKSTARS, comprendre le TF-IDF est le premier pas indispensable pour construire des systèmes de recherche, des classifieurs de documents ou des outils d’extraction de mots-clés performants.

1. La fréquence des termes (TF) : La mesure de la saillance locale

Le premier composant du TF-IDF est la fréquence des termes (Term Frequency). L’intuition est simple : plus un mot apparaît souvent dans un document, plus il est probable qu’il soit représentatif du sujet traité. Si vous lisez un texte où le mot “IA” apparaît vingt fois, il y a de fortes chances que le sujet soit lié à l’intelligence artificielle.

Cependant, le comptage brut présente un défaut majeur : les documents longs ont naturellement des fréquences plus élevées pour tous les mots. Pour corriger cela, le TF est généralement normalisé. On divise le nombre d’occurrences du mot par le nombre total de mots dans le document. Cela permet de comparer des textes de longueurs disparates. Pour les experts de DATAROCKSTARS, cette normalisation est la base de toute analyse statistique propre, car elle évite le biais lié à la taille des échantillons.

2. La fréquence inverse de document (IDF) : L’art de filtrer le bruit

Si le TF nous indique l’importance locale d’un mot, il ne nous dit rien sur sa rareté. Des mots comme “le”, “la”, “et”, “est” apparaissent partout. S’ils sont fréquents partout, ils ne nous aident pas à distinguer un document d’un autre. C’est là qu’intervient l’IDF (Inverse Document Frequency). L’IDF réduit le poids des mots qui apparaissent dans une grande proportion de documents de votre corpus.

La formule de l’IDF utilise un logarithme pour atténuer l’effet des mots très fréquents. Si un mot apparaît dans tous les documents, son IDF sera proche de zéro, ce qui “éteint” quasiment son importance. À l’inverse, un mot rare qui apparaît dans peu de documents aura un IDF élevé, le propulsant au rang de mot-clé discriminant. Apprendre à équilibrer cette vision locale et globale est une compétence clé que nous transmettons dans nos cursus de Data Scientist & AI, car c’est la différence entre une IA qui s’égare dans le bruit et une IA qui se concentre sur le signal.

3. La formule mathématique : Comprendre la mécanique

Le score TF-IDF est simplement le produit de ces deux mesures : TF(t,d)×IDF(t,D). Le TF mesure l’importance du terme t dans le document d, tandis que l’IDF mesure l’importance globale du terme t dans le corpus D.

Mathématiquement, le résultat est un score qui récompense les mots qui sont à la fois fréquents dans le document cible et rares dans le reste des documents. C’est un indicateur très puissant pour la classification. Chez DATAROCKSTARS, nous apprenons à nos étudiants que ce calcul, bien qu’arithmétique, est une forme d’abstraction sémantique. Vous transformez une distribution de mots en une empreinte digitale statistique unique pour chaque document. Cette rigueur mathématique est ce qui permet de déployer des modèles de NLP fiables en environnement de production.

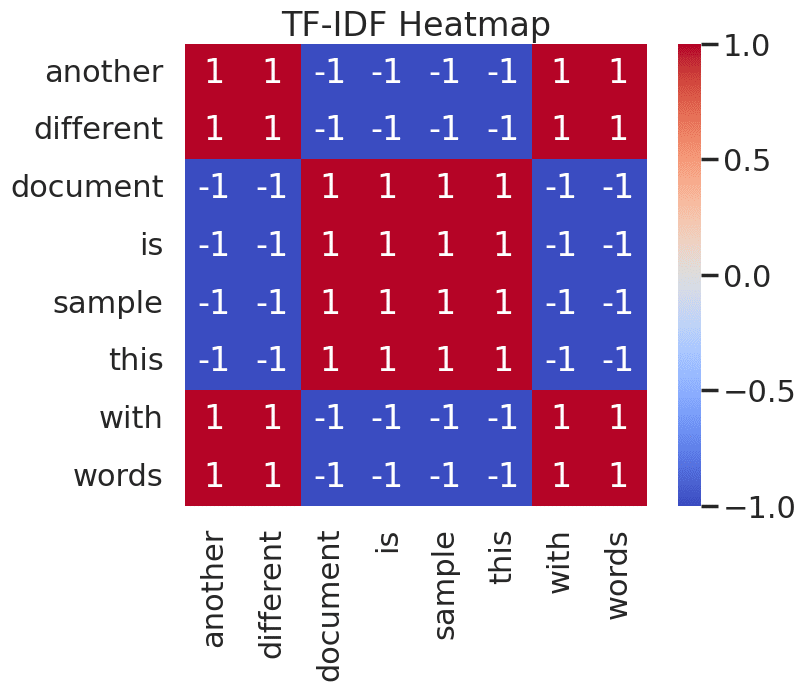

4. De la chaîne de caractères aux vecteurs : La vectorisation

Une fois le score TF-IDF calculé, chaque document est représenté par un vecteur de nombres. Si votre corpus contient 10 000 mots uniques, chaque document devient un vecteur à 10 000 dimensions, où chaque valeur correspond au score TF-IDF d’un mot précis. La majorité de ces valeurs sont à zéro, car aucun document ne contient tous les mots du corpus. On parle alors de “vecteurs creux” (sparse vectors).

Cette représentation vectorielle est le pont indispensable vers le Machine Learning. Une fois que vos textes sont devenus des vecteurs, vous pouvez calculer la similarité entre deux textes grâce à la mesure de “similitude cosinus”. Deux textes parlant du même sujet auront des vecteurs pointant dans la même direction. C’est la base de tout moteur de recherche moderne. Nos Bootcamps Data Engineer & AIOps utilisent ces concepts pour construire des pipelines qui indexent des millions de documents pour des clients industriels.

5. Les avantages : Simplicité et efficacité computationnelle

Pourquoi utiliser le TF-IDF alors que nous avons des modèles de langage complexes comme BERT ou GPT ? La réponse est la performance et la simplicité. Le TF-IDF est extrêmement rapide à calculer, demande peu de ressources de calcul (pas besoin de GPU pour l’inférence), et fonctionne très bien avec peu de données d’entraînement. C’est le “baseline model” idéal.

Dans de nombreux cas d’usage — comme la classification de tickets de support client ou le filtrage de spams simples — un modèle basé sur TF-IDF battra des modèles deep learning complexes en termes de temps de réponse et de facilité de maintenance. Chez DATAROCKSTARS, nous enseignons toujours à commencer par un modèle simple avant de complexifier. Savoir quand utiliser le TF-IDF plutôt qu’un LLM est une compétence de Senior qui permet de réduire les coûts cloud et de simplifier radicalement l’architecture de vos applications.

6. Les limites structurelles : Quand le contexte échappe au modèle

Le TF-IDF a des limites intrinsèques : il ignore totalement l’ordre des mots et la sémantique. Pour le TF-IDF, les phrases “Le chat mange la souris” et “La souris mange le chat” ont exactement la même signature statistique. Il ne comprend pas non plus les synonymes : “voiture” et “automobile” seront traités comme deux mots totalement indépendants, sans aucun lien mathématique entre eux.

C’est là que le modèle atteint son plafond. Si votre projet nécessite une compréhension fine du contexte ou une analyse des sentiments nuancée, le TF-IDF ne suffira pas. C’est à ce moment-là que nous introduisons le passage vers les modèles de Deep Learning. La compréhension de ces limites est cruciale. Chez DATAROCKSTARS, nous ne vous apprenons pas à être “fan” d’un algorithme, mais à être un architecte capable de choisir le bon outil pour le bon problème.

7. Évolution technologique : De TF-IDF vers les Embeddings

Le monde du NLP a évolué vers les “embeddings” (Word2Vec, BERT, etc.). Au lieu d’une représentation basée sur la fréquence, on utilise une représentation basée sur le sens. Dans un espace d’embeddings, le mot “roi” est proche du mot “reine” grâce à la structure sémantique apprise par le modèle. Ces modèles surpassent largement le TF-IDF pour les tâches complexes.

Toutefois, le TF-IDF reste utile. Il est souvent utilisé en complément des modèles avancés pour des tâches de recherche initiale (retrieval) dans les architectures RAG (Retrieval-Augmented Generation). Le mélange de la recherche par mots-clés (TF-IDF/BM25) et de la recherche sémantique (Embeddings) est une technique de pointe pour optimiser la qualité des réponses d’un agent IA. C’est ce type d’architecture hybride que nous détaillons dans notre formation en cybersécurité et en ingénierie IA.

8. Mise en pratique : L’implémentation avec Scikit-Learn

En Python, la bibliothèque scikit-learn rend l’implémentation du TF-IDF triviale avec la classe TfidfVectorizer. En quelques lignes de code, vous nettoyez, tokenisez et vectorisez un corpus entier. C’est un outil incroyablement puissant pour transformer des fichiers texte en matrices numériques prêtes pour le Machine Learning.

Python

from sklearn.feature_extraction.text import TfidfVectorizer

vectorizer = TfidfVectorizer()

X = vectorizer.fit_transform(corpus)

Dans nos exercices pratiques chez DATAROCKSTARS, nous montrons comment affiner ces vecteurs : comment gérer les “stop words” (mots inutiles), comment définir la taille maximale du vocabulaire, et comment utiliser des n-grams (combiner les mots par paires ou triplets) pour capter un peu plus de contexte. La maîtrise de ces paramètres est ce qui transforme un résultat correct en un résultat performant.

9. Cas d’usage : Où utiliser TF-IDF en entreprise ?

Le TF-IDF est très présent dans les moteurs de recherche d’entreprise (Enterprise Search), dans les systèmes de recommandation de contenu, ou pour l’auto-classification de documents juridiques et comptables. Si vous avez une bibliothèque de milliers de contrats, le TF-IDF est un outil fantastique pour indexer ces documents et permettre une recherche instantanée sur des termes techniques précis.

Chez DATAROCKSTARS, nous aidons nos partenaires à déployer ces solutions. Que ce soit pour organiser un Knowledge Base ou pour monitorer des flux RSS, le TF-IDF reste une solution simple, robuste et efficace. Comprendre comment l’appliquer concrètement dans le contexte d’une entreprise est ce que nous valorisons dans tous nos cursus, car nous formons des professionnels capables d’apporter de la valeur dès leur premier jour en poste.

10. Pourquoi maîtriser ces bases est votre avantage compétitif

Savoir utiliser TF-IDF, c’est savoir parler le langage de base de la donnée textuelle. Beaucoup de profils juniors se précipitent sur les dernières architectures de réseaux de neurones sans comprendre les fondations mathématiques qui les ont précédées. En comprenant le TF-IDF, vous comprenez la racine du traitement du texte. Cette profondeur vous rend plus agile, plus critique et plus efficace dans le choix de vos solutions techniques.

Chez DATAROCKSTARS, nous bâtissons votre expertise sur ces fondations solides. Ne soyez pas juste un utilisateur d’outils, soyez un architecte qui comprend le “pourquoi” derrière le “comment”. Rejoignez nos cursus pour acquérir cette maîtrise indispensable. Souhaitez-vous découvrir comment notre Bootcamp Data Scientist & AI peut vous propulser au rang des experts incontournables du domaine ?

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !