Dans l’univers de la gestion de données, si la consultation est reine, l’acquisition est le fondement. L’instruction INSERT INTO est la commande SQL fondamentale qui permet d’ajouter de nouveaux enregistrements dans une table de base de données relationnelle. Que vous enregistriez une transaction de vente, capturiez un log de connexion ou importiez un dataset massif dans un Data Lake, INSERT INTO est le point d’entrée universel. En 2026, cette commande n’est plus seulement tapée manuellement par un administrateur ; elle est le moteur de pipelines d’automatisation complexes reliant le système d’information à l’intelligence artificielle.

Pour les analystes et ingénieurs formés chez DATAROCKSTARS, maîtriser l’insertion de données est une compétence de base indispensable. Savoir structurer ces requêtes pour garantir l’intégrité et la performance est une brique essentielle des métiers data qui recrutent. Ce guide exhaustif de 2000 mots décompose les 10 piliers de l’alimentation de données en SQL.

1. Définition et Syntaxe de base : La porte d’entrée du SQL

La syntaxe standard de INSERT INTO nécessite de spécifier le nom de la table, les colonnes cibles et les valeurs correspondantes. Il existe deux variantes principales :

- Spécifier les colonnes (Recommandé) :

INSERT INTO table (col1, col2) VALUES (val1, val2); - Sans spécifier les colonnes :

INSERT INTO table VALUES (val1, val2, ...);(Nécessite de connaître l’ordre exact des colonnes).

Chez DATAROCKSTARS, nous insistons sur la spécification systématique des colonnes pour assurer la maintenance applicative et éviter les erreurs lors des évolutions de schémas de table.

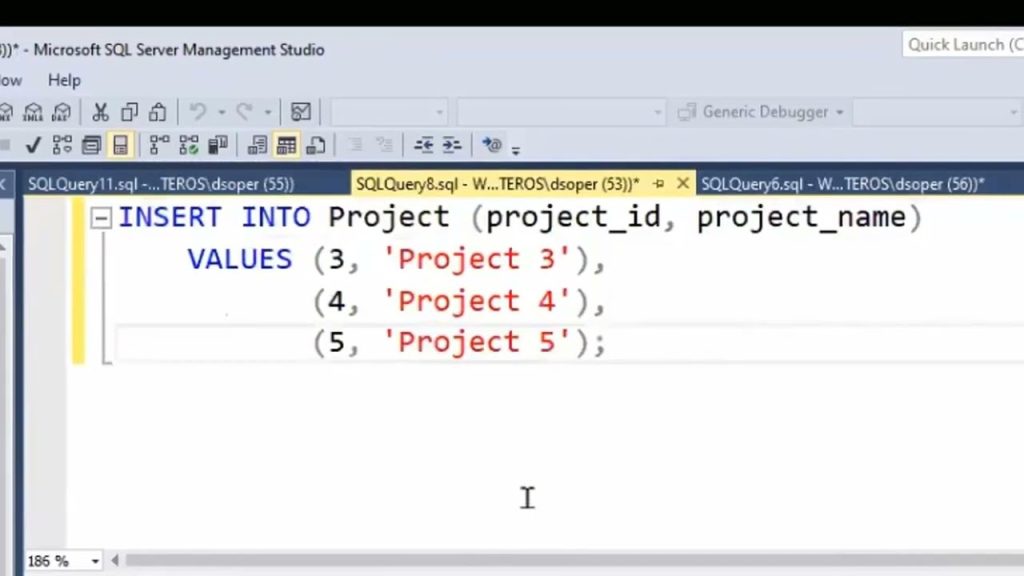

2. L’insertion multiple (Bulk Insert) : Optimiser la performance

Insérer des données une par une est inefficace pour le Big Data. Le SQL moderne permet d’insérer plusieurs lignes en une seule instruction : INSERT INTO table (col1) VALUES (valA), (valB), (valC);. Cette méthode réduit drastiquement les allers-retours avec le serveur et la charge sur le Cloud Computing, accélérant l’ingestion de données par un facteur 10 ou plus.

3. INSERT INTO SELECT : Migrer et transformer les données

L’une des formes les plus puissantes de cette commande est la copie de données entre tables : INSERT INTO table_cible SELECT * FROM table_source;. C’est l’outil privilégié pour les processus ETL (Extract, Transform, Load). Dans un bootcamp de Data Science, on l’utilise souvent pour préparer des échantillons de données ou consolider des informations provenant de différentes sources avant l’analyse.

4. Gestion des contraintes et intégrité des données

Chaque insertion doit respecter les règles de la base de données :

- NOT NULL : La colonne doit recevoir une valeur.

- UNIQUE : La valeur ne doit pas déjà exister (ex: un email client).

- FOREIGN KEY : La valeur doit exister dans une table de référence (ex: un ID produit valide).

Si une contrainte est violée, l’insertion échoue. Maîtriser ces règles est un aspect vital pour tout savoir sur la qualité des données et éviter la corruption du patrimoine informationnel.

5. L’instruction “UPSERT” (INSERT ON CONFLICT)

En 2026, on rencontre souvent le besoin de “mettre à jour si la donnée existe déjà, sinon l’insérer”. C’est ce qu’on appelle l’UPSERT. En PostgreSQL, on utilise ON CONFLICT DO UPDATE. Cette logique est cruciale pour synchroniser des flux de données en temps réel sans créer de doublons, une compétence clé pour les Agents IA & Automations.

6. Automatisation avec Python et SQLAlchemy

Dans le monde professionnel, les requêtes INSERT INTO sont rarement écrites à la main. On utilise le langage Python avec des bibliothèques comme SQLAlchemy ou Pandas (to_sql). Cela permet d’insérer automatiquement des données extraites par web scraping ou provenant d’APIs tierces, transformant Excel en un outil de collecte passif.

7. Ingestion massive et Data Engineering

Pour des millions de lignes, même le Bulk Insert atteint ses limites. Les Data Engineers utilisent alors des commandes spécifiques comme COPY (PostgreSQL) ou LOAD DATA (MySQL/Snowflake). Ces méthodes lisent directement des fichiers CSV ou Parquet stockés sur un stockage objet (S3, Google Cloud Storage) pour alimenter le Data Lake à une vitesse fulgurante.

8. Cybersécurité : Se protéger contre l’Injection SQL

L’instruction INSERT INTO est une cible privilégiée pour les attaques par injection SQL. Un pirate peut tenter d’insérer du code malveillant via un formulaire de saisie. Pour tout savoir sur la cybersécurité des bases de données, il est impératif d’utiliser des requêtes préparées (Prepared Statements) qui séparent le code SQL des données utilisateur.

9. Transactions et Rollbacks : Sécuriser l’écriture

Lorsqu’on insère des données liées (ex: une commande et ses articles), il faut que tout soit inséré ou rien du tout. On utilise pour cela les transactions (BEGIN, COMMIT, ROLLBACK). Si l’insertion des articles échoue, on annule l’insertion de la commande pour maintenir la cohérence du système d’information.

10. Conclusion : Pourquoi maîtriser l’insertion avec DATAROCKSTARS ?

Maîtriser INSERT INTO en 2026, c’est savoir comment construire les fondations de l’intelligence. Sans une ingestion de données propre, rapide et sécurisée, aucun modèle de Machine Learning ne peut être entraîné efficacement.

Le cursus de DATAROCKSTARS vous offre une expertise complète, de la requête SQL simple aux pipelines d’ingestion complexes. En apprenant à alimenter correctement vos systèmes, vous devenez un garant de la fiabilité des données, prêt à relever les défis de l’industrie de la donnée.

Aspirez-vous à maîtriser les rouages du Big Data et à concevoir des pipelines d’ingestion ultra-performants ? Notre formation Data Engineer & AIOps vous apprend à orchestrer l’écosystème SQL et l’automatisation des flux, afin de propulser votre expertise vers les frontières de l’ingénierie moderne.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !