La notion de limite est le socle sur lequel repose tout l’édifice du calcul infinitésimal. Sans elle, nous ne pourrions pas définir la dérivée, l’intégrale, ou même comprendre le comportement asymptotique des algorithmes que nous utilisons quotidiennement en Data Science et en informatique. Pour beaucoup, les limites évoquent des souvenirs scolaires complexes et abstraits, mais dans la pratique de l’ingénierie et de l’intelligence artificielle, elles deviennent des outils pragmatiques pour mesurer la stabilité, la convergence et la performance. Chez DATAROCKSTARS, nous pensons que la compréhension des limites est ce qui distingue un utilisateur de bibliothèque “boîte noire” d’un ingénieur capable de concevoir, d’optimiser et de débugger ses propres systèmes d’IA. Cet article explore les limites, de l’intuition géométrique aux applications concrètes dans les systèmes distribués et le Machine Learning.

1. L’intuition mathématique : Qu’est-ce qu’une limite ?

De manière intuitive, une limite permet de décrire le comportement d’une fonction lorsque la variable d’entrée s’approche d’une valeur précise, sans pour autant l’atteindre. Imaginez que vous tracez une courbe ; la limite vous répond à la question : “Vers quelle valeur la fonction tend-elle lorsque x se rapproche de a ?”. C’est une notion de voisinage. On ne s’intéresse pas à ce qui se passe en a (la fonction pourrait même y être indéfinie), mais à ce qui se passe autour de a.

Cette approche “par voisinage” est révolutionnaire car elle permet de manipuler l’infini et les points de discontinuité. En mathématiques, on note cela de façon formelle par l’expression suivante : $\lim_{x \to a} f(x) = L$. Cela signifie que lorsque $x$ devient arbitrairement proche de $a$, $f(x)$ devient arbitrairement proche de $L$. Cette abstraction est le langage de base de toute analyse de fonction et est essentielle pour comprendre les fondements de la logique algorithmique que nous enseignons dans nos formations chez DATAROCKSTARS.

2. La définition formelle : Le concept epsilon-delta

Pour les mathématiciens, la définition “intuitive” ne suffit pas. Au XIXe siècle, les mathématiciens comme Cauchy et Weierstrass ont formalisé cette notion avec la célèbre définition “epsilon-delta”. Dire que $\lim_{x \to a} f(x) = L$ signifie que pour tout nombre $\epsilon > 0$ (aussi petit soit-il), il existe un nombre $\delta > 0$ tel que si la distance entre $x$ et $a$ est inférieure à $\delta$, alors la distance entre $f(x)$ et $L$ est inférieure à $\epsilon$.

Cette définition peut paraître intimidante, mais elle est le fondement de la rigueur scientifique. Elle nous assure que la fonction “se serre” autour de la limite. En informatique, cette rigueur est ce qui garantit qu’un algorithme de convergence (comme la descente de gradient) finira par atteindre une précision donnée. Lorsque nous abordons ces concepts chez DATAROCKSTARS, nous ne cherchons pas à vous faire réciter des théorèmes, mais à vous faire comprendre la logique de précision : une erreur qui devient arbitrairement petite est le but recherché dans toute optimisation logicielle.

3. Les limites à l’infini : Comprendre la croissance asymptotique

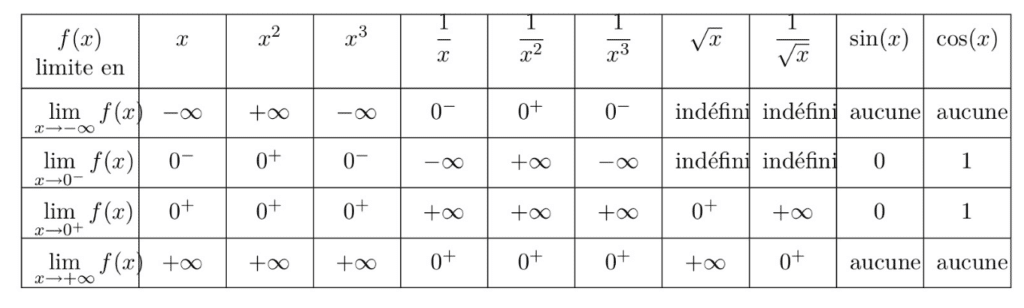

S’intéresser à la limite d’une fonction lorsque $x$ tend vers l’infini ($+\infty$ ou $-\infty$) est crucial pour analyser la complexité algorithmique. C’est ce qu’on appelle l’analyse asymptotique. Dans le monde du Big Data, la question n’est pas “combien de temps mon algorithme met-il sur 100 lignes ?”, mais “comment se comporte-t-il lorsque le nombre de lignes $n$ tend vers l’infini ?”. C’est ici que naît la notation Grand O (Big O).

Si une fonction de complexité $f(n)$ a une limite infinie à croissance rapide, votre algorithme ne passera jamais à l’échelle sur des datasets industriels. Apprendre à calculer ces limites permet de prédire si une architecture tiendra la charge avant même de l’avoir déployée sur le Cloud. C’est un sujet que nous approfondissons dans notre Bootcamp Data Engineer & AIOps, car un ingénieur qui comprend le comportement asymptotique de ses fonctions est un ingénieur qui évite les désastres de performance en production.

4. Les formes indéterminées : Le casse-tête du calcul

Parfois, le calcul direct d’une limite mène à des expressions du type $\frac{0}{0}$, $\frac{\infty}{\infty}$, $0 \times \infty$ ou $\infty – \infty$. Ce sont ce qu’on appelle des “formes indéterminées”. Elles ne sont pas des erreurs en soi, mais des indications que la fonction a un comportement complexe à cet endroit précis. Par exemple, la fonction $\frac{\sin(x)}{x}$ en $x=0$ donne $\frac{0}{0}$. Pourtant, la limite existe et vaut 1.

Savoir manipuler ces formes est essentiel pour résoudre des problèmes d’optimisation. Lorsque vous entraînez un modèle de Deep Learning, vous pouvez rencontrer des cas où le gradient devient instable (valeurs trop petites ou trop grandes). Savoir appliquer les techniques de levée d’indétermination — comme les développements limités ou la règle de L’Hôpital — permet de stabiliser les calculs. C’est ce genre de maîtrise technique qui distingue les experts de DATAROCKSTARS des développeurs qui se reposent uniquement sur les bibliothèques logicielles.

5. La règle de L’Hôpital : Un outil de simplification puissant

Quand nous faisons face à une forme indéterminée de type $\frac{0}{0}$ ou $\frac{\infty}{\infty}$, la règle de L’Hôpital est une méthode élégante pour trouver la limite. Elle stipule que, sous certaines conditions, la limite du quotient de deux fonctions est égale à la limite du quotient de leurs dérivées : $\lim_{x \to a} \frac{f(x)}{g(x)} = \lim_{x \to a} \frac{f'(x)}{g'(x)}$.

C’est un outil très puissant pour simplifier des expressions complexes. En Data Science, cela aide à comprendre la stabilité des fonctions de perte (loss functions) que l’on optimise par descente de gradient. Si la dérivée est bien comportée, l’optimisation sera stable. Chez DATAROCKSTARS, nous ne vous apprenons pas seulement à calculer des limites pour le plaisir, mais pour comprendre la stabilité mathématique des modèles que vous déployez. Savoir quand une dérivée devient une limite utile est une compétence clé pour le réglage fin des hyperparamètres.

6. Limites et continuité : Le lien organique

La notion de limite est intimement liée à celle de continuité. Une fonction est continue en un point $a$ si et seulement si la limite de la fonction en $a$ est égale à la valeur de la fonction en $a$ ($\lim_{x \to a} f(x) = f(a)$). Si cette égalité n’est pas vérifiée, la fonction présente une discontinuité. En informatique, les fonctions “escalier” ou les fonctions de seuil (comme la fonction Heaviside) sont discontinues.

Cette discontinuité pose un problème majeur en Machine Learning car, pour utiliser la descente de gradient, nous avons besoin que la fonction soit dérivable, et donc continue. C’est pourquoi nous utilisons des fonctions d’activation comme la Sigmoïde ou la ReLU : elles sont continues et dérivables, permettant ainsi au modèle d’apprendre par rétropropagation. Comprendre le lien entre limite, continuité et dérivabilité est indispensable pour construire des architectures de réseaux de neurones performantes, un concept central dans notre Bootcamp Data Scientist & AI.

7. Les limites dans les algorithmes de convergence

Tous les algorithmes d’optimisation reposent sur la notion de limite. La descente de gradient cherche le minimum d’une fonction en calculant successivement des points dont la limite tend vers le minimum global. Si l’algorithme ne “converge” pas, c’est que la limite du processus est inexistante ou divergente.

Pour un Data Engineer, savoir si un algorithme va converger est crucial. Si la limite est “infinie” ou “oscillante”, votre modèle ne sera jamais entraîné correctement. La maîtrise des suites et des séries, qui sont des types particuliers de limites, est donc fondamentale. Chez DATAROCKSTARS, nous utilisons ces bases théoriques pour vous apprendre à configurer les taux d’apprentissage et à détecter les problèmes de convergence avant qu’ils ne consument des heures de calcul GPU inutile.

8. Calculs numériques et limites : La réalité du code

Dans le monde réel de l’informatique, le calcul des limites est contraint par la précision des nombres flottants (floating point numbers). L’ordinateur ne connaît pas l’infini, il connaît inf. Il ne connaît pas “arbitrairement proche”, il connaît epsilon (la plus petite valeur représentable). Cela crée des phénomènes d’instabilité numérique.

Savoir que le calcul informatique est une approximation de la limite mathématique est essentiel. Par exemple, calculer $f(x+h) – f(x) / h$ pour une très petite valeur de $h$ est une approximation de la dérivée (qui est une limite). Si $h$ est trop petit, les erreurs d’arrondi numérique dominent. Dans nos formations, nous apprenons aux ingénieurs à manipuler ces calculs avec prudence, en utilisant des bibliothèques robustes comme NumPy ou SciPy qui gèrent ces limitations mathématiques de manière native, assurant ainsi la précision de vos calculs.

9. Les outils modernes pour le calcul des limites

Heureusement, vous n’avez plus besoin de calculer toutes vos limites à la main. Des outils puissants comme WolframAlpha, ou des bibliothèques Python comme SymPy, permettent de calculer symboliquement des limites très rapidement. SymPy est particulièrement utile pour les Data Scientists qui veulent vérifier leurs calculs théoriques.

Par exemple, sympy.limit(sin(x)/x, x, 0) retourne 1 instantanément. Pour les ingénieurs chez DATAROCKSTARS, l’objectif est d’utiliser ces outils pour automatiser la vérification de leurs hypothèses mathématiques. L’intelligence humaine sert à poser le problème et à comprendre le résultat ; la machine sert à effectuer le calcul symbolique. C’est ce couple humain-machine que nous promouvons dans nos cursus. Apprendre à utiliser SymPy, c’est gagner en productivité et en précision dans la conception de vos modèles.

10. Pourquoi les limites sont indispensables pour votre carrière

Pourquoi passer du temps sur les limites de fonctions en 2026 ? Parce que les ingénieurs qui réussissent ne sont pas ceux qui savent juste appeler model.fit(), mais ceux qui comprennent ce qui se passe quand le modèle s’entraîne. Comprendre les limites, c’est comprendre la convergence, c’est comprendre la stabilité, et c’est comprendre les contraintes de vos systèmes.

Chez DATAROCKSTARS, nous vous donnons ces fondations théoriques non pour vous faire souffrir, mais pour vous rendre autonomes et critiques face aux technologies. La maîtrise de ces concepts vous donne une longueur d’avance pour résoudre des problèmes que les outils “prêts à l’emploi” ne peuvent pas gérer. Rejoignez nos cursus pour bâtir cette expertise profonde et devenir l’expert dont les entreprises technologiques ont désespérément besoin. Souhaitez-vous découvrir comment notre Bootcamp Data Scientist & AI peut transformer votre compréhension mathématique en une expertise métier concrète ?

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !