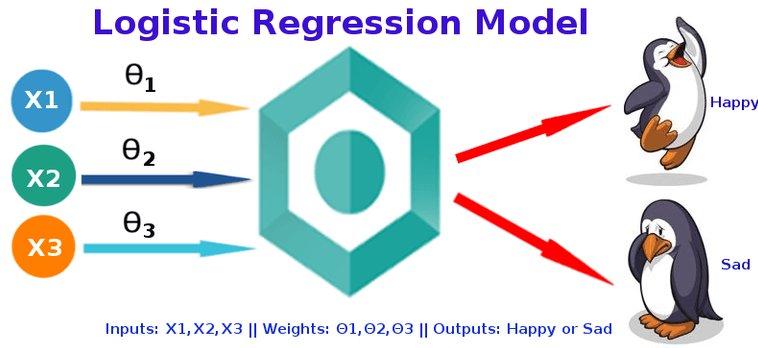

La regression logistique est l’un des algorithmes les plus fondamentaux et les plus puissants du Machine Learning. Contrairement à ce que son nom suggère, elle n’est pas utilisée pour prédire une valeur continue (comme le prix d’une maison), mais pour résoudre des problèmes de classification, le plus souvent binaire (Oui/Non, Fraude/Légitime, Malade/Sain). Elle transforme une combinaison linéaire de variables d’entrée en une probabilité comprise entre 0 et 1 grâce à une fonction mathématique spécifique. Dans le patrimoine informationnel d’une entreprise, la régression logistique est le moteur qui permet au système d’information de prendre des décisions catégorielles automatiques sur le Cloud Computing, offrant une base solide pour le Data Management et la gestion des risques.

Pour les talents formés chez DATAROCKSTARS, maîtriser la régression logistique est le passage obligé vers la Data Science appliquée. Que vous soyez futur Data Scientist ou Analyste, savoir modéliser ces probabilités est une compétence clé des métiers data qui recrutent. Ce dossier approfondi explore les 10 dimensions de cet algorithme essentiel.

1. La fonction Sigmoïde : Le cœur du mécanisme

Au centre de la régression logistique se trouve la fonction logistique, également appelée fonction sigmoïde. Sa formule mathématique est $f(z) = \frac{1}{1 + e^{-z}}$. Cette courbe en forme de “S” a une propriété unique : elle écrase n’importe quelle valeur d’entrée (de $-\infty$ à $+\infty$) pour la ramener dans un intervalle strict entre 0 et 1. En langage Python, cette transformation permet de convertir un score de prédiction en une probabilité exploitable par le système d’information. C’est cet aspect vital qui permet de donner un sens statistique aux données brutes issues du patrimoine informationnel.

2. Distinction entre régression linéaire et logistique

Une confusion fréquente existe entre ces deux méthodes. La régression linéaire tente de tracer une droite pour prédire un chiffre précis. Cependant, si on l’utilise pour de la classification, une seule valeur extrême (outlier) peut fausser toute la ligne. La régression logistique résout ce problème en s’adaptant à la nature catégorielle des données. Elle ne cherche pas à passer “par” les points, mais à séparer les classes. Dans le cadre du Data Management, cette distinction est cruciale pour choisir le bon outil de Data Science et éviter des erreurs d’interprétation majeures sur le Cloud Computing.

3. Le concept de “Log-Odds” et de Logit

Pour lier la probabilité aux variables d’entrée, l’algorithme utilise les “odds” (chances), définies par le rapport $\frac{p}{1-p}$. En prenant le logarithme népérien de ce rapport, on obtient le “Logit”. Cette transformation mathématique permet de rendre la relation entre les variables et la probabilité linéaire, facilitant ainsi le calcul des coefficients par le système d’information. Comprendre cette mécanique interne est essentiel pour la maintenance applicative des modèles et pour interpréter comment chaque donnée du patrimoine informationnel influence la décision finale de l’intelligence artificielle.

4. Estimation du Maximum de Vraisemblance (MLE)

Contrairement à la régression linéaire qui utilise les moindres carrés, la régression logistique utilise l’Estimation du Maximum de Vraisemblance (Maximum Likelihood Estimation). L’objectif est de trouver les paramètres qui rendent les observations réelles les plus “probables” selon le modèle. C’est un processus itératif gourmand en calcul, souvent réalisé sur le Cloud Computing. Cette optimisation garantit que le modèle de Data Science est le plus fidèle possible à la réalité historique du patrimoine informationnel, minimisant ainsi les erreurs de classification.

5. Le seuil de décision (Decision Threshold)

Une fois que le modèle a calculé une probabilité (par exemple 0.7), le système d’information doit décider d’une classe. Par défaut, le seuil est fixé à 0.5 : au-dessus, c’est “1”, en dessous, c’est “0”. Cependant, en cybersécurité, on peut choisir un seuil plus bas pour être plus sensible aux menaces, ou plus haut pour éviter les faux positifs. Ajuster ce seuil est un aspect vital pour tout savoir sur l’équilibre entre précision et rappel, une compétence de Data Management indispensable pour aligner l’IA avec les besoins métiers réels.

6. Évaluation du modèle : La matrice de confusion

On n’évalue pas une régression logistique avec le $R^2$ mais avec une matrice de confusion. Elle récapitule les Vrais Positifs, Vrais Négatifs, Faux Positifs et Faux Négatifs. À partir de là, on calcule l’Exactitude (Accuracy), la Précision et le Rappel (Recall). Ces métriques sont le tableau de bord de la Business Intelligence. Elles permettent de valider si l’algorithme protège efficacement le patrimoine informationnel ou s’il nécessite un réentraînement avec des données SQL plus fraîches ou mieux qualifiées.

7. La courbe ROC et l’AUC

Pour mesurer la performance globale du modèle indépendamment du seuil choisi, on utilise la courbe ROC (Receiver Operating Characteristic) et l’aire sous la courbe (AUC). Une AUC proche de 1 indique un modèle parfait, tandis qu’une valeur de 0.5 correspond à un choix aléatoire. Dans le Cloud Computing, ces indicateurs permettent de comparer rapidement plusieurs versions d’un algorithme de Data Science pour ne déployer que la plus performante au sein du système d’information de l’entreprise.

8. Régularisation (L1 et L2) contre le Surapprentissage

Le surapprentissage (overfitting) survient quand le modèle apprend par cœur le bruit du patrimoine informationnel plutôt que la tendance. Pour contrer cela, on utilise la régularisation Lasso (L1) ou Ridge (L2), qui pénalise les coefficients trop élevés. Cette technique de maintenance applicative mathématique assure que l’algorithme restera capable de généraliser ses prédictions sur de nouvelles données entrantes. C’est une protection indispensable pour garantir la stabilité du Data Management face à l’évolution constante des flux numériques.

9. Régression Logistique Multinomiale

Bien qu’initialement binaire, l’algorithme peut être étendu pour classer des données dans plus de deux catégories (ex: classer des emails en “Privé”, “Professionnel” ou “Spam”). On utilise alors la fonction Softmax au lieu de la Sigmoïde. Cette extension décuple les possibilités de la Business Intelligence, permettant de segmenter le patrimoine informationnel avec une finesse chirurgicale. Les Agents IA & Automations s’appuient massivement sur ces modèles multiclasses pour orienter les processus métiers de manière autonome.

10. Importance des variables et interprétabilité

L’un des plus grands atouts de la régression logistique par rapport aux réseaux de neurones est sa “transparence”. On peut lire les coefficients pour comprendre quelle variable a le plus d’impact sur la probabilité. En cybersécurité ou en banque, cette interprétabilité est une exigence réglementaire. Savoir expliquer pourquoi une transaction a été refusée est une obligation légale. Cette clarté fait de la régression logistique l’outil de prédilection pour une intelligence artificielle responsable et auditable au sein du système d’information.

La régression logistique est la boussole de la classification. En 2026, posséder cette expertise, c’est être capable de transformer l’incertitude des probabilités en décisions binaires nettes et efficaces. Maîtriser cet algorithme, c’est savoir comment le monde numérique catégorise le réel, comment les risques sont évalués et comment les opportunités sont saisies. C’est la compétence pivot qui relie la rigueur statistique à l’action stratégique.

Chez DATAROCKSTARS, nous vous formons à cette ingénierie de précision. En rejoignant nos cursus, vous apprenez à modéliser des comportements complexes, à sécuriser vos analyses et à bâtir des solutions d’intelligence artificielle prêtes pour l’échelle industrielle. Ne vous contentez pas de collecter des données : apprenez à les classer pour devenir un leader de la révolution technologique.

Aspirez-vous à maîtriser les rouages des modèles de langage et à concevoir des solutions d’IA ultra-performantes ? Notre formation Data Scientist & AI Engineer vous apprend à exploiter l’écosystème Python et le traitement intelligent des flux sémantiques, afin de propulser votre expertise vers les frontières de l’innovation moderne.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !