Le Transformeur Génératif Pré-entraîné (plus connu sous l’acronyme anglais GPT) représente une avancée majeure dans le domaine du traitement du langage naturel (NLP). Contrairement aux anciens modèles qui lisaient le texte mot après mot, le transformeur utilise un mécanisme d’attention pour analyser l’intégralité d’une séquence de données simultanément. Cette capacité permet à l’intelligence artificielle de comprendre le contexte profond, les nuances et les relations complexes entre les mots, faisant d’elle un outil de création et d’analyse sans précédent au sein du système d’information moderne.

Pour les professionnels qui souhaitent ne pas se contenter d’utiliser l’IA mais de la bâtir, DATAROCKSTARS propose des cursus d’ingénierie de pointe. En apprenant à manipuler ces architectures via le langage Python et les infrastructures de Cloud Computing, vous rejoignez l’élite des métiers data qui recrutent, capables de déployer des solutions d’IA générative à l’échelle industrielle.

1. Définition et origine : La naissance du mécanisme d’Attention

L’architecture du transformeur a été introduite par Google en 2017 dans l’article “Attention Is All You Need”. Elle a remplacé les réseaux de neurones récurrents (RNN) qui étaient limités par leur traitement séquentiel lent. Le transformeur repose sur le concept de “Self-Attention” (auto-attention), qui permet au modèle de peser l’importance de chaque mot par rapport aux autres dans une phrase, peu importe leur distance.

2. Le concept de “Génératif” : Créer à partir du néant

Le terme “Génératif” signifie que le modèle est conçu pour produire de nouvelles données. À partir d’un “prompt” (une instruction), le modèle prédit le mot suivant le plus probable en fonction de tout ce qu’il a appris précédemment. En répétant cette opération des milliers de fois par seconde, il génère des textes cohérents, du code informatique ou même des analyses de données complexes. C’est cette brique qui alimente aujourd’hui l’intelligence artificielle générative grand public.

3. L’importance du “Pré-entraînement” : Apprendre sur le Web

Le “Pré-entraînement” est la phase où le modèle ingère des volumes colossaux de données (textes, livres, code source) pour apprendre la structure du langage et des connaissances générales. Ce processus nécessite une puissance de calcul massive, souvent distribuée sur des milliers de GPUs. Une fois pré-entraîné, le modèle possède une “compréhension” du monde qu’il peut ensuite affiner (fine-tuning) pour des tâches spécifiques comme la finance ou la santé.

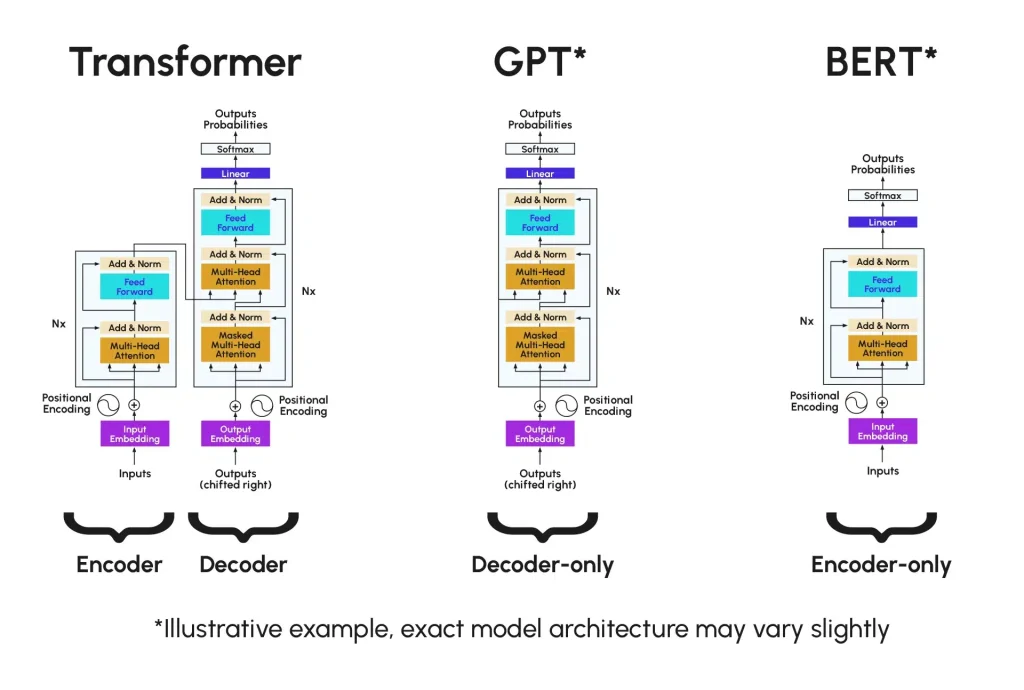

4. L’architecture interne : Encodeur, Décodeur et Attention Multitête

Techniquement, un transformeur se compose de deux parties : l’encodeur (qui comprend l’entrée) et le décodeur (qui génère la sortie). Dans le cas spécifique des modèles GPT, on utilise principalement la partie décodeur. L’attention multitête permet au modèle de regarder simultanément différentes parties d’une phrase sous plusieurs angles (syntaxe, sémantique, contexte temporel), ce qui lui confère une finesse d’analyse inégalée par rapport aux bases de données SQL classiques.

5. À quoi servent les GPT dans le monde professionnel ?

Dans le secteur de la Vente, les GPT sont utilisés pour personnaliser les interactions clients à une échelle industrielle. Dans l’Ingénierie logicielle, ils assistent les développeurs en suggérant des fonctions entières ou en identifiant des bugs complexes. En entreprise, un GPT peut agir comme un expert capable de synthétiser des milliers de documents internes stockés dans un Data Lake pour répondre à une question stratégique en quelques secondes.

6. Classement des 10 capacités clés des modèles transformeurs

- Synthèse de texte : Résumer des documents longs en points clés.

- Génération de code : Écrire des scripts en Python, Java ou SQL.

- Traduction contextuelle : Traduire entre des dizaines de langues avec une précision humaine.

- Analyse de sentiment : Détecter l’émotion derrière un texte client.

- Extraction d’entités : Identifier des noms, dates ou lieux dans des données brutes.

- Raisonnement logique : Résoudre des problèmes mathématiques ou logiques étape par étape.

- Classification : Ranger automatiquement des milliers d’emails ou de documents.

- Rédaction créative : Générer des emails, des articles ou des scripts marketing.

- Correction d’erreurs : Reformuler et corriger la grammaire ou le style.

- Interaction conversationnelle : Maintenir un dialogue cohérent sur la durée.

7. L’impact sur l’automatisation : Vers les Agents IA

Le transformeur est le cerveau des Agents IA. Au lieu de simplement répondre à une question, l’agent utilise le modèle pour planifier une suite d’actions : chercher une information avec PhantomBuster, l’analyser, et l’intégrer dans un rapport. Cette vision est au cœur de notre formation Agents IA & Automations de DATAROCKSTARS, où nous apprenons à transformer ces modèles en travailleurs autonomes.

8. Cybersécurité : Les risques liés aux modèles génératifs

La puissance des GPT apporte de nouveaux défis de cybersécurité. Des acteurs malveillants peuvent les utiliser pour générer des emails de phishing ultra-réalistes ou pour créer des logiciels malveillants polymorphes. De plus, la protection des données d’entraînement contre le “prompt injection” est devenue vitale.

Pour tout savoir sur la cybersécurité liée à l’IA, le passage par un bootcamp spécialisé chez DATAROCKSTARS est essentiel pour apprendre à sécuriser les déploiements de modèles au sein du système d’information.

9. Déploiement et Scalabilité : Cloud, Docker et MLOps

Mettre un modèle GPT en production ne se limite pas à l’écriture du code. Il faut gérer l’infrastructure via le Cloud Computing, conteneuriser l’application avec Docker pour assurer sa portabilité, et surveiller ses performances via des outils de MLOps comme MLflow.

Cette expertise technique globale est enseignée dans le Bootcamp Data Engineer & AIOps de DATAROCKSTARS. Nous formons des ingénieurs capables de bâtir les pipelines qui alimentent, surveillent et sécurisent ces modèles géants à l’échelle de l’entreprise.

10. Conclusion et perspectives d’avenir

Le Transformeur Génératif Pré-entraîné n’est pas une simple mode technologique, c’est un changement de paradigme. En 2026, il est le socle sur lequel se construit la nouvelle économie de l’intelligence. Maîtriser son fonctionnement, c’est posséder la clé de l’automatisation et de la création de valeur pour la décennie à venir.

L’avenir appartient à ceux qui sauront murmurer à l’oreille de ces modèles pour transformer des pétaoctets de données en intelligence pure. En vous formant chez DATAROCKSTARS, vous vous positionnez à l’avant-garde de cette révolution.

Aspirez-vous à maîtriser les rouages de l’intelligence artificielle et à concevoir des agents capables de transformer vos données ? Notre formation Agents IA & Automations vous apprend à explorer l’écosystème des transformeurs et du traitement intelligent des flux, afin de propulser votre expertise vers les frontières de l’innovation moderne.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de l’IA, de la Data et de l’automatisation, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !