Dans l’écosystème technologique de 2026, la donnée n’est plus une ressource statique stockée dans des silos ; elle est un flux continu et vital. Apache Kafka est la plateforme de “distributed event streaming” (diffusion d’événements distribuée) qui permet de capturer, stocker et traiter des flux de données en temps réel à une échelle massive. Originellement développé par LinkedIn, Kafka est devenu le standard industriel pour connecter des microservices, alimenter des pipelines de Data Science et synchroniser des bases de données SQL avec une latence quasi nulle. Au sein d’un système d’information moderne, Kafka agit comme un bus de données ultra-performant sur le Cloud Computing, garantissant que chaque message atteint sa destination avec une tolérance aux pannes exceptionnelle.

Pour les talents formés chez DATAROCKSTARS, maîtriser Kafka est le summum de l’ingénierie de données en temps réel. Que vous soyez futur Data Engineer ou architecte d’Agents IA & Automations, savoir piloter ces flux est une compétence d’élite des métiers data qui recrutent. Ce dossier approfondi explore les 10 dimensions stratégiques de Kafka en 10 pavés détaillés.

1. L’architecture Pub/Sub et le concept d’Événement

Kafka repose sur un modèle de publication/abonnement (Publish/Subscribe). Un “événement” est une donnée décrivant un changement d’état (un achat, un clic, une alerte de cybersécurité). Les “Producers” envoient ces événements dans Kafka, tandis que les “Consumers” s’y abonnent pour les traiter. Cette architecture découple totalement les systèmes émetteurs des systèmes récepteurs. En 2026, cette flexibilité est un aspect vital pour tout savoir sur l’agilité logicielle. Elle permet d’ajouter de nouveaux services au système d’information sans jamais modifier les sources existantes, assurant une évolution fluide du patrimoine informationnel de l’entreprise sur le Cloud Computing.

2. Les Topics et les Partitions : Scalabilité horizontale

Les données dans Kafka sont organisées en “Topics” (sujets). Pour supporter des volumes de données gigantesques, chaque Topic est divisé en “Partitions” réparties sur plusieurs serveurs (Brokers). Cette fragmentation permet à Kafka de paralléliser les écritures et les lectures, offrant une capacité de traitement de millions de messages par seconde. Dans le cadre du Data Management, cette structure garantit que le système peut grandir indéfiniment en ajoutant simplement des machines. C’est le pilier de la haute disponibilité sur le Cloud Computing, permettant de gérer des flux de Data Science mondiaux sans aucun goulot d’étranglement technique.

3. La persistance et le Log d’événements

Contrairement aux systèmes de messagerie traditionnels qui suppriment les messages une fois lus, Kafka est un journal de bord (Log) immuable. Les événements sont stockés sur disque pour une durée configurable. Cette persistance permet aux Agents IA & Automations de “rejouer” le passé pour corriger des erreurs ou pour entraîner des modèles sur des données historiques réelles. Cette capacité de rétention transforme Kafka en une véritable base de données temporelle, un élément de maintenance applicative crucial pour auditer le patrimoine informationnel et garantir la traçabilité des opérations au sein de l’organisation.

4. Les Brokers et le Cluster : Résilience totale

Un environnement Kafka est composé d’un ensemble de serveurs appelés “Brokers” formant un cluster. Chaque partition de donnée est répliquée sur plusieurs Brokers. Si l’un d’eux tombe en panne sur le Cloud Computing, un autre prend immédiatement le relais sans perte de données. Cette tolérance aux pannes est indispensable pour les applications critiques de cybersécurité ou de finance. Chez DATAROCKSTARS, nous apprenons à nos étudiants à configurer ces facteurs de réplication pour bâtir des infrastructures indestructibles, protégeant ainsi l’actif le plus précieux de l’entreprise : sa donnée en mouvement.

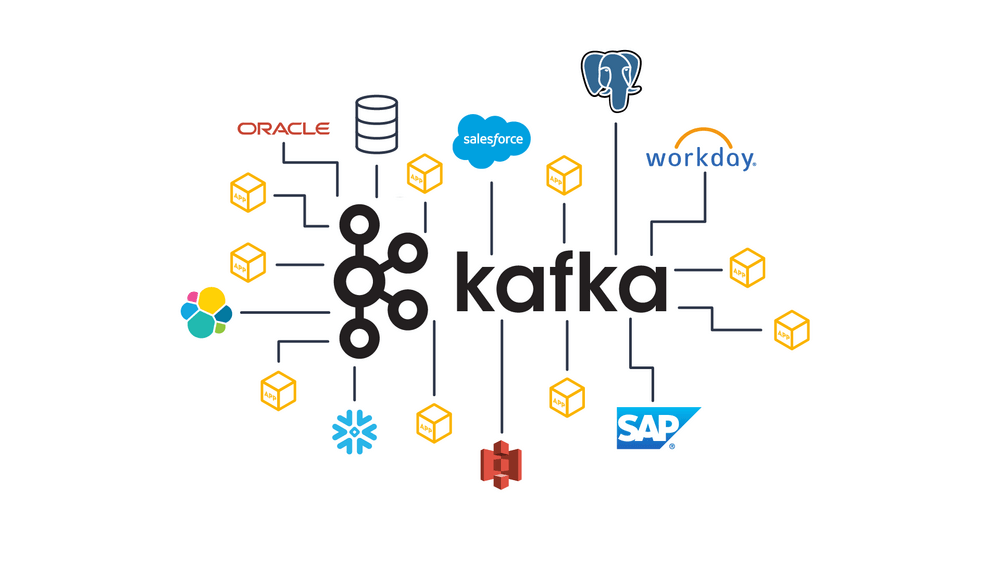

5. Kafka Connect : L’intégration universelle

Kafka ne vit pas en vase clos. Grâce à Kafka Connect, il peut s’interfacer nativement avec des centaines de sources (bases SQL, Salesforce, SAP) et de destinations (S3, Elasticsearch, Snowflake). Ce framework permet de créer des pipelines d’ingestion sans écrire une seule ligne de code complexe. Pour un Data Engineer, c’est l’outil de prédilection pour synchroniser le patrimoine informationnel en temps réel. En automatisant ces flux, l’entreprise réduit ses coûts de maintenance applicative et accélère la mise à disposition des données pour les algorithmes de Data Science et d’intelligence artificielle.

6. Kafka Streams : Le traitement au fil de l’eau

Au-delà du simple transport, Kafka permet de transformer les données pendant qu’elles circulent via la bibliothèque Kafka Streams. Vous pouvez filtrer, agréger ou joindre des flux de données en continu directement en langage Python ou Java. En 2026, cette capacité de “Stream Processing” est utilisée pour détecter des fraudes bancaires à la milliseconde ou pour ajuster les prix de vente dynamiquement. C’est le cœur des Agents IA & Automations réactifs, capables de prendre des décisions intelligentes avant même que la donnée ne soit stockée dans un datawarehouse final.

7. Le rôle crucial de Zookeeper et KRaft

Pour coordonner l’ensemble des Brokers et gérer les métadonnées du cluster, Kafka a longtemps dépendu d’Apache Zookeeper. Cependant, en 2026, le protocole KRaft (Kafka Raft) a pris le dessus, permettant à Kafka de s’auto-gérer sans service externe. Cette simplification architecturale améliore les performances et facilite la maintenance applicative sur le Cloud Computing. Comprendre cette évolution interne est essentiel pour les experts formés chez DATAROCKSTARS, car elle impacte directement la scalabilité et la sécurité du système d’information distribué de nouvelle génération.

8. Cybersécurité : Sécuriser les flux d’événements

Un bus de données centralisé est une cible de choix. Kafka intègre des mécanismes de sécurité robustes : chiffrement TLS des données en transit, authentification SASL/Kerberos et listes de contrôle d’accès (ACLs) granulaires. En cybersécurité, il est impératif de garantir que seul un service autorisé peut “produire” ou “consommer” un type de message spécifique. Protéger ces flux, c’est sécuriser les artères du patrimoine informationnel. Un cluster Kafka mal configuré pourrait exposer l’intégralité des secrets de l’entreprise, d’où l’importance d’une expertise pointue en gestion des accès et en chiffrement.

9. Performance et Latence : L’optimisation Zero-Copy

Kafka doit sa rapidité légendaire à une technique appelée “Zero-Copy”. Les données sont transférées directement du cache du système d’exploitation vers la carte réseau sans passer par l’espace utilisateur de l’application. Cette optimisation réduit la charge processeur et la latence, permettant à Kafka de saturer les liens réseau les plus rapides sur le Cloud Computing. Maîtriser ces concepts de bas niveau permet aux ingénieurs de Data Management de dimensionner correctement leurs clusters pour supporter des charges de travail extrêmes tout en minimisant les coûts d’infrastructure du système d’information.

10. L’avenir de Kafka : Serverless et IA Intégrée

En 2026, Kafka évolue vers des modèles “Serverless” où la gestion des Brokers est totalement automatisée par les fournisseurs Cloud. Parallèlement, l’intégration de modèles d’intelligence artificielle directement au sein des flux de streaming devient la norme. On parle de “Intelligence on the Wire” : le flux de données est analysé et enrichi par des modèles de Data Science en temps réel avant même d’arriver au consommateur final. Kafka devient ainsi l’infrastructure de base pour les Agents IA & Automations autonomes, redéfinissant les limites de ce qui est possible dans le monde numérique.

Conclusion : Pourquoi maîtriser Apache Kafka avec DATAROCKSTARS ? Apache Kafka est bien plus qu’un outil informatique ; c’est le socle de l’entreprise temps réel de 2026. Dans un monde où la vitesse de réaction est le principal facteur de succès, savoir orchestrer les flux de données est la compétence la plus recherchée du marché. Maîtriser Kafka, c’est posséder les clés du système d’information de demain et la capacité de transformer un déluge de données en une source continue de valeur stratégique.

Chez DATAROCKSTARS, nous vous formons à cette excellence technique et architecturale. En rejoignant nos cursus, vous apprenez à bâtir des clusters résilients, à coder des pipelines de streaming performants et à sécuriser vos échanges de données critiques. Ne vous contentez pas de stocker le passé : apprenez à piloter le présent pour devenir un leader de la révolution technologique.

Aspirez-vous à maîtriser les rouages des modèles de langage et à concevoir des solutions d’IA ultra-performantes ? Notre formation Data Engineer & AIOps vous apprend à exploiter l’écosystème Python et le traitement intelligent des flux sémantiques, afin de propulser votre expertise vers les frontières de l’innovation moderne.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !