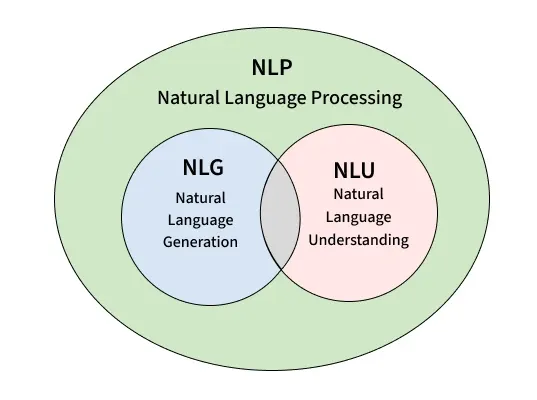

La NLG (Natural Language Generation) est une sous-discipline de l’intelligence artificielle qui consiste à transformer des données structurées en langage naturel compréhensible par l’homme. Contrairement à la NLU (Natural Language Understanding) qui lit, la NLG écrit. En 2026, cette technologie a franchi un cap historique grâce aux Large Language Models (LLM) comme ChatGPT, Claude, Gemini ou Mistral. Dans un système d’information moderne, la NLG est le pivot indispensable pour automatiser la rédaction de rapports, la création de contenus marketing ou la réponse client personnalisée. Elle permet de valoriser le patrimoine informationnel brut en le traduisant instantanément en récits fluides et actionnables sur le Cloud Computing.

Pour les talents formés chez DATAROCKSTARS, la NLG est l’outil ultime de l’automatisation cognitive. Que vous soyez futur AI Engineer ou Content Specialist, maîtriser ces systèmes est une compétence clé des métiers data qui recrutent.

1. La transition de la donnée brute au récit structuré

Le premier rôle de la NLG est de donner une voix aux chiffres. Elle prend des jeux de données complexes (bases SQL, logs, métriques financières) et les transforme en paragraphes cohérents. Cette capacité de “traduction” du patrimoine informationnel est un aspect vital pour tout savoir sur la Business Intelligence : elle permet au système d’information de communiquer des résultats complexes à des non-experts sans intervention humaine. Sur le Cloud Computing, cela signifie que des milliers de rapports personnalisés peuvent être générés en quelques secondes, garantissant une diffusion fluide de la connaissance au sein de l’organisation.

2. L’évolution des modèles : du template au Deep Learning

Historiquement, la NLG reposait sur des systèmes de modèles (templates) rigides et répétitifs. Aujourd’hui, elle s’appuie sur le Deep Learning et les réseaux de neurones transformeurs. Ces modèles analysent le patrimoine informationnel sémantique pour prédire la suite logique d’une phrase. Cette profondeur technologique permet de générer des textes d’une qualité humaine, capables de varier le ton et le style. Pour le Data Management, cette évolution marque la fin des contenus robotiques, intégrant une créativité artificielle au cœur du système d’information d’entreprise.

3. L’impact des LLM leaders (ChatGPT, Claude, Mistral)

L’émergence de modèles comme GPT-4, Claude 3.5 ou le champion européen Mistral a radicalement changé la donne. Ces moteurs de NLG ne se contentent plus de décrire des données ; ils raisonnent et synthétisent. Ils transforment le patrimoine informationnel mondial en une source de création quasi infinie. Intégrés au système d’information, ces outils permettent aux Agents IA & Automations de produire du code, des articles de blog ou des emails de prospection d’une pertinence absolue, optimisant chaque interaction sur le Cloud Computing.

4. Personnalisation de masse et expérience client

La NLG permet de créer des expériences uniques pour des millions d’utilisateurs simultanément. En piochant dans le patrimoine informationnel client (préférences, historique d’achat), le système d’information génère des messages ultra-ciblés. Cette personnalisation n’est plus une option mais un standard de la Data Science marketing. Sur le Cloud Computing, la NLG assure que chaque point de contact est pertinent, augmentant l’engagement et transformant la relation client en un flux de dialogue constant et automatisé.

5. NLG et aide au développement (Coding Assistance)

Une application majeure de la NLG est la génération de code. Des modèles comme Gemini ou Llama assistent les développeurs en rédigeant des fonctions entières à partir de commentaires. Cette automatisation du patrimoine informationnel technique accélère la maintenance applicative et le déploiement de nouveaux services. Au sein du système d’information, la NLG réduit la dette technique en suggérant des optimisations et en documentant automatiquement le code, une révolution pour le Data Management logiciel.

6. Défis de fiabilité : Hallucinations et Fact-Checking

Le principal risque de la NLG moderne réside dans les “hallucinations”, où l’IA génère des informations fausses mais crédibles. La protection du patrimoine informationnel exige donc la mise en place de systèmes de vérification. En Data Science, on utilise des techniques de RAG (Retrieval-Augmented Generation) pour forcer l’IA à s’appuyer sur des sources vérifiées au sein du système d’information. Cette rigueur est un aspect vital pour tout savoir sur la confiance numérique et la cybersécurité des contenus générés sur le Cloud Computing.

7. Multilinguisme et traduction sémantique

La NLG excelle dans la suppression des barrières linguistiques. Des modèles comme Claude ou Mistral peuvent générer du contenu dans des dizaines de langues avec une compréhension parfaite des nuances locales. Cette capacité valorise le patrimoine informationnel international de l’entreprise. En automatisant la traduction sémantique, le système d’information devient global par défaut, permettant une collaboration sans frontières et une expansion rapide sur le Cloud Computing.

8. Génération de résumés et synthèse d’information

Face à l’infobésité, la NLG agit comme un filtre intelligent. Elle est capable de résumer des milliers de documents en quelques points clés. Cette synthèse du patrimoine informationnel est essentielle pour les décideurs qui doivent traiter des volumes massifs de données. Les Agents IA & Automations utilisent la NLG pour extraire la substantifique moelle des flux de données, rendant le système d’information plus agile et les prises de décision plus rapides.

9. Éthique, Droits d’Auteur et AI Act

La production massive de textes par la NLG soulève des questions juridiques complexes. À qui appartient le patrimoine informationnel généré par une IA ? Le cadre européen (AI Act) impose une transparence sur l’origine des contenus. La gouvernance du système d’information doit donc inclure des marquages (watermarking) pour identifier les productions artificielles. Ce volet de la cybersécurité et du Data Management est crucial pour protéger la propriété intellectuelle sur le Cloud Computing.

10. L’avenir : La NLG multimodale et agentique

En 2026, la NLG ne se limite plus au texte. Elle s’intègre dans des systèmes multimodaux capables de commenter des images ou de créer des scripts vidéo via des outils comme Nano Banana Pro. Cette évolution vers une IA agentique permet de créer des assistants capables de mener des actions complexes en totale autonomie. Le patrimoine informationnel devient alors proactif : le système d’information ne se contente plus de stocker, il communique et interagit de manière créative sur le Cloud Computing.

La NLG est la plume de l’intelligence artificielle. Posséder cette maîtrise technique permet de transformer le silence des données en une parole stratégique, de sécuriser ses communications et de valoriser son patrimoine informationnel. C’est la compétence pivot qui fait passer l’informatique de l’exécution à la narration.

Chez DATAROCKSTARS, nous vous formons à cette révolution linguistique. En rejoignant nos cursus, vous apprenez à dompter les modèles génératifs, à automatiser vos flux rédactionnels et à bâtir des solutions d’intelligence artificielle qui parlent le langage de votre succès. Ne vous laissez pas dépasser par le volume des données, apprenez à les faire chanter pour devenir un leader de la révolution technologique.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !