Le devops c’est quoi ? C’est avant tout une culture et un ensemble de pratiques qui visent à unifier le développement logiciel (Dev) et l’administration des infrastructures informatiques (Ops). L’objectif principal est de réduire le temps entre le moment où un développeur écrit une ligne de code et celui où cette fonctionnalité est disponible en production sur le Cloud Computing, tout en garantissant une qualité optimale. Dans un système d’information moderne, le DevOps casse les silos traditionnels pour créer un cycle de vie logiciel fluide, automatisé et collaboratif. C’est le moteur qui permet de gérer le patrimoine informationnel technique avec une agilité sans précédent.

Pour les talents formés chez DATAROCKSTARS, le DevOps est le socle de l’ingénierie moderne. Que vous soyez futur Data Engineer ou Cloud Architect, maîtriser cette méthodologie est une compétence clé des métiers data qui recrutent.

1. La fin des silos : Collaboration et Culture

Historiquement, les développeurs créaient le code et les “Ops” s’occupaient de le faire fonctionner, ce qui créait souvent des frictions. Le DevOps impose une responsabilité partagée sur l’ensemble du cycle de vie du produit. Cette culture de collaboration est un aspect vital pour tout savoir sur l’efficacité organisationnelle. Elle assure que le patrimoine informationnel technique ne reste pas bloqué entre deux départements, mais circule librement pour alimenter le système d’information de l’entreprise de manière continue.

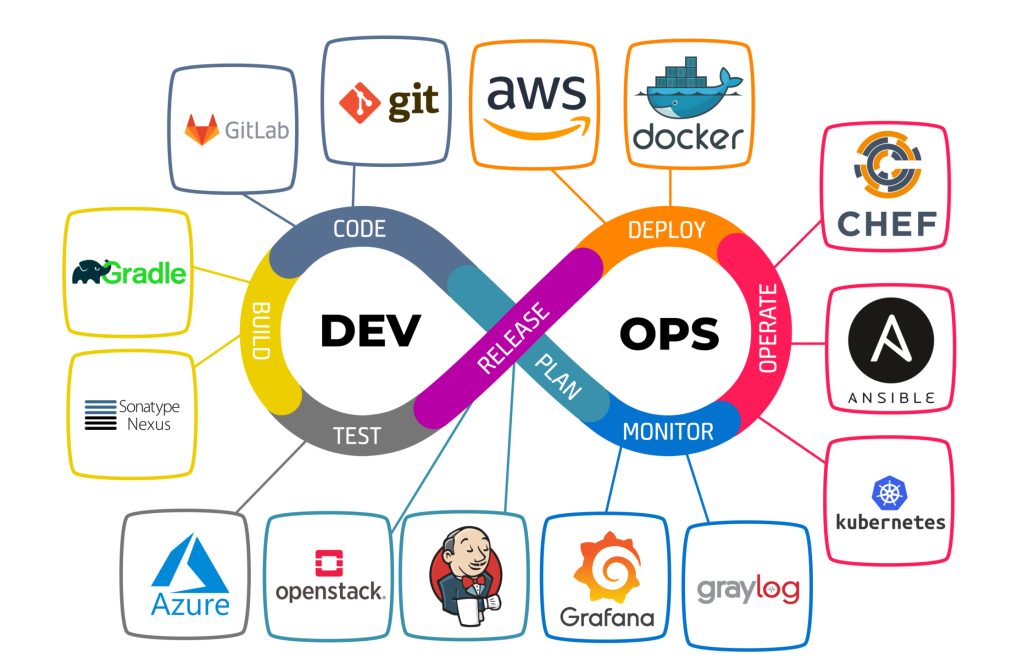

2. Le cycle de vie en boucle infinie (Infinite Loop)

Le DevOps est souvent représenté par un symbole de l’infini ($\infty$). Il comprend plusieurs étapes : Plan, Code, Build, Test, Release, Deploy, Operate et Monitor. Ce cycle perpétuel permet une amélioration constante. Chaque retour d’expérience en production nourrit la planification de la version suivante. Cette itération rapide sur le Cloud Computing permet de transformer le patrimoine informationnel en fonctionnalités concrètes à une vitesse que les méthodes traditionnelles “en cascade” ne peuvent égaler.

3. L’Intégration Continue (CI – Continuous Integration)

La CI consiste à intégrer les modifications de code des développeurs dans un tronc commun plusieurs fois par jour. Chaque intégration est vérifiée par des tests automatisés en langage Python ou autres. Cette pratique de Data Management technique permet de détecter les bugs au plus tôt, avant qu’ils ne polluent le patrimoine informationnel global. Elle garantit que le code est toujours dans un état “prêt à être construit”, renforçant la stabilité du système d’information.

4. Le Déploiement Continu (CD – Continuous Deployment)

Le CD prolonge la CI en automatisant la mise en production du code ayant réussi les tests. Grâce au Cloud Computing, une nouvelle fonctionnalité peut être déployée sans intervention humaine manuelle. Cette automatisation réduit les erreurs humaines et permet de livrer de la valeur aux utilisateurs de manière quasi instantanée. Pour les experts de DATAROCKSTARS, le “pipeline CI/CD” est l’autoroute qui transporte le patrimoine informationnel du développement vers les serveurs de production.

5. L’Infrastructure as Code (IaC)

Avec le DevOps, on ne configure plus les serveurs à la main. On écrit du code (scripts Terraform ou Ansible) qui définit l’infrastructure nécessaire sur le Cloud Computing. Cette approche permet de versionner l’infrastructure comme on versionne le logiciel. C’est une révolution pour le Data Management des ressources matérielles : l’infrastructure devient reproductible, documentée et sécurisée. Elle fait désormais partie intégrante du patrimoine informationnel technique du système d’information.

6. Le Monitoring et le Logging en temps réel

On ne peut pas améliorer ce qu’on ne mesure pas. Le DevOps s’appuie sur une surveillance constante de la santé des applications et des serveurs. Les logs (journaux d’événements) constituent un patrimoine informationnel précieux pour identifier les goulots d’étranglement ou les tentatives d’intrusion en cybersécurité. Cette visibilité totale permet une maintenance applicative proactive, où les problèmes sont résolus avant même que l’utilisateur final ne s’en aperçoive sur le Cloud Computing.

7. La Micro-segmentation et les Conteneurs (Docker, K8s)

Le DevOps privilégie l’utilisation de conteneurs pour isoler les applications et leurs dépendances. Des outils comme Docker et Kubernetes permettent de déployer le patrimoine informationnel applicatif de manière identique sur n’importe quel environnement. Cette portabilité simplifie le travail des développeurs et des Ops, assurant que le système d’information reste cohérent que l’on soit en phase de test ou en production sur le Cloud Computing.

8. La Sécurité intégrée : Le DevSecOps

La sécurité ne doit pas être une étape finale, mais être intégrée dès le début du code. C’est le principe du “Shift Left”. Le DevSecOps automatise les scans de vulnérabilités au sein même du pipeline de déploiement. Cette protection du patrimoine informationnel technique dès sa création est un aspect vital pour tout savoir sur la résilience numérique. Elle garantit que chaque mise à jour du système d’information respecte les normes de cybersécurité les plus strictes.

9. Le DevOps appliqué à la Data : Le DataOps

Le DataOps adapte les principes DevOps au cycle de vie de la donnée. Il vise à automatiser la collecte, le nettoyage et la distribution du patrimoine informationnel pour les équipes de Data Science. En appliquant la CI/CD aux bases de données SQL, on s’assure que les analystes travaillent toujours sur des données fraîches et fiables. C’est le moteur de la Business Intelligence moderne, permettant une agilité totale dans l’exploitation des actifs de l’entreprise.

10. L’avenir du DevOps : AIOps et automatisation intelligente

L’intelligence artificielle s’invite dans le DevOps pour créer l’AIOps. Des Agents IA & Automations analysent les métriques de performance pour prédire les pannes ou ajuster automatiquement les ressources sur le Cloud Computing. Cette évolution ultime permet au système d’information de s’auto-réparer et de s’auto-optimiser. Le DevOps devient alors le cadre où l’IA gère l’infrastructure pour libérer les humains vers des tâches de création et de stratégie.

Le DevOps est le système nerveux de l’entreprise technologique. Posséder cette expertise permet de transformer la lenteur des processus manuels en une fluidité automatisée, de sécuriser le patrimoine informationnel et de garantir une innovation constante. C’est la compétence pivot qui relie la rigueur de l’administration système à l’agilité du développement logiciel.

Chez DATAROCKSTARS, nous vous formons à cette maîtrise des flux et de l’automatisation. En rejoignant nos cursus, vous apprenez à orchestrer des pipelines complexes, à sécuriser vos infrastructures cloud et à bâtir des solutions d’intelligence artificielle robustes. Ne vous contentez pas de coder : apprenez à déployer le futur pour devenir un leader de la révolution technologique.

Aspirez-vous à maîtriser les rouages de l’ingénierie moderne et à devenir un expert des infrastructures agiles ? Notre formation Data Engineer & AIOps vous apprend à exploiter l’écosystème DevOps et le traitement intelligent des flux, afin de propulser votre expertise vers les frontières de l’innovation moderne.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !