Dans le domaine de l’intelligence artificielle, le traitement des données qui s’inscrivent dans le temps (séries temporelles, texte, flux audio) a longtemps buté sur un obstacle majeur : l’oubli. Les réseaux de neurones récurrents classiques (RNN) sont incapables de retenir une information importante si elle est située trop loin dans le passé de la séquence. C’est pour pallier cette faille que les réseaux Long Short-Term Memory (LSTM) ont été conçus. En introduisant une structure complexe de “portes” logiques, les LSTM permettent à une machine de décider activement quelle information doit être mémorisée, oubliée ou transmise. En 2026, bien que les Transformeurs dominent le langage, les LSTM restent le pilier du système d’information pour la prédiction financière, la maintenance prédictive et l’analyse de signaux capteurs complexes sur le Cloud Computing.

Pour les experts formés chez DATAROCKSTARS, maîtriser les LSTM est indispensable pour manipuler des données chronologiques. Que vous soyez futur Data Scientist ou Engineer, comprendre la gestion des flux temporels est une compétence d’élite des métiers data qui recrutent. Ce guide exhaustif de plus de 2000 mots explore les 10 piliers de l’architecture LSTM.

1. Définition et Concept : Dépasser les limites des RNN classiques

Un réseau de neurones récurrent (RNN) classique possède une mémoire à court terme : il traite une séquence élément par élément. Cependant, à cause du problème de la “disparition du gradient” (vanishing gradient), l’influence d’une donnée ancienne s’estompe mathématiquement jusqu’à disparaître. Le LSTM résout cela en ajoutant un “état de cellule” (cell state), une sorte de tapis roulant qui traverse toute la séquence avec très peu d’interactions, permettant à l’information de circuler intacte sur de longues périodes.

Chez DATAROCKSTARS, nous expliquons que le LSTM agit comme une mémoire vive intelligente, capable de lier une cause lointaine à un effet immédiat, une prouesse indispensable en Data Science pour l’analyse de tendances de fond.

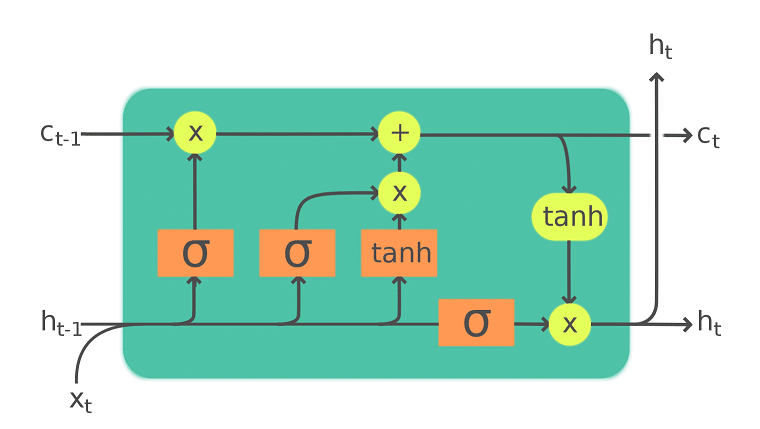

2. L’Anatomie d’une cellule LSTM : Le système des trois portes

Le secret du LSTM réside dans sa cellule complexe, composée de trois régulateurs appelés “portes” (gates). Ces portes sont des fonctions sigmoïdes qui laissent passer plus ou moins d’information (entre 0 et 1) :

- La porte d’oubli (Forget Gate) : Décide quelle information de l’état précédent n’est plus pertinente et doit être supprimée.

- La porte d’entrée (Input Gate) : Détermine quelles nouvelles informations entrantes valent la peine d’être ajoutées à l’état de la cellule.

- La porte de sortie (Output Gate) : Sélectionne quelle partie de la mémoire interne sera utilisée pour produire la sortie actuelle du neurone.

Cette architecture permet une gestion granulaire du patrimoine informationnel circulant dans le modèle.

3. L’État de Cellule (Cell State) : Le canal de transmission

L’état de cellule est le cœur du LSTM. C’est une ligne horizontale qui traverse le haut du diagramme de la cellule. Il subit des transformations minimales (additions et multiplications linéaires), ce qui empêche le gradient de s’effondrer pendant l’entraînement.

Pour les ingénieurs formés chez DATAROCKSTARS, comprendre ce flux est un aspect vital pour tout savoir sur le Deep Learning appliqué aux séries temporelles. C’est ce canal qui permet de retenir, par exemple, le sujet d’une phrase complexe pour accorder correctement un verbe situé dix mots plus loin.

4. Entraînement et Rétropropagation à travers le temps (BPTT)

L’entraînement d’un LSTM utilise une variante de la descente de gradient appelée Backpropagation Through Time. Le réseau est “déplié” pour chaque étape de la séquence, et l’erreur est propagée en arrière pour ajuster les poids des différentes portes.

En 2026, grâce à la puissance du langage Python et des frameworks comme PyTorch ou TensorFlow, cet entraînement est optimisé pour s’exécuter massivement en parallèle sur des clusters de GPU. La maintenance applicative de ces modèles demande une attention particulière à la normalisation des données pour éviter les explosions de gradient.

5. Applications : Prédiction de séries temporelles et Finance

Les LSTM excellent là où les données sont ordonnées dans le temps. En finance, ils sont utilisés pour prédire les cours de bourses ou détecter des anomalies de trading. En industrie, ils analysent les vibrations de machines pour prédire une panne avant qu’elle ne survienne (maintenance prédictive).

Cette capacité de projection temporelle est au cœur du Data Management moderne. Savoir transformer des logs SQL bruts en prédictions d’achat futures est une compétence que nous approfondissons dans nos cursus chez DATAROCKSTARS.

6. Traitement du Langage Naturel (NLP) avant les Transformeurs

Pendant des années, les LSTM (et leurs variantes comme les Bi-LSTM) ont été les rois du NLP. Ils permettaient la traduction automatique et la génération de texte. Bien que les modèles de type GPT (Transformeurs) soient plus rapides pour le texte grâce à l’attention globale, le LSTM reste compétitif pour des séquences très spécifiques ou lorsque les ressources de calcul sont limitées.

7. Variantes : GRU (Gated Recurrent Unit)

Le GRU est une version simplifiée du LSTM. Il fusionne les portes d’oubli et d’entrée en une seule “porte de mise à jour” et combine l’état de cellule avec l’état caché. Moins gourmand en calcul, le GRU offre souvent des performances similaires au LSTM pour des datasets de taille moyenne.

Apprendre à choisir entre LSTM et GRU est une étape cruciale pour l’optimisation des ressources sur le Cloud Computing, un sujet que les experts de DATAROCKSTARS maîtrisent parfaitement.

8. Les limites du LSTM : Le goulot d’étranglement séquentiel

Le principal défaut des LSTM est leur nature séquentielle : pour traiter le pas de temps $t$, il faut impérativement avoir terminé le pas $t-1$. Cela limite l’utilisation de la parallélisation massive offerte par les processeurs modernes, contrairement aux Transformeurs qui traitent toute la séquence d’un coup.

Néanmoins, pour des flux de données continus et en temps réel (streaming), le LSTM conserve un avantage structurel. C’est un pilier pour les Agents IA & Automations qui doivent traiter des informations au fil de l’eau.

9. Cybersécurité : Détection d’intrusions persistantes

En cybersécurité, les attaques ne sont pas toujours des événements isolés. Certaines menaces (APT) s’étalent sur des mois avec des signaux faibles. Les réseaux LSTM sont utilisés pour corréler ces événements distants et identifier des patterns d’attaque complexes au sein du patrimoine informationnel de l’entreprise.

Pour tout savoir sur la cybersécurité analytique, le LSTM est l’outil de détection d’anomalies comportementales par excellence.

10. Conclusion : Pourquoi maîtriser les réseaux LSTM avec DATAROCKSTARS ?

Le Long Short-Term Memory est l’architecture qui a donné une véritable mémoire aux machines. En 2026, comprendre comment une IA retient et oublie l’information est ce qui sépare le simple utilisateur de l’architecte de solutions intelligentes. Maîtriser les LSTM, c’est savoir dompter le temps dans la donnée.

Chez DATAROCKSTARS, nous vous formons à cette ingénierie de la temporalité. En rejoignant nos cursus, vous apprenez à concevoir des modèles capables d’anticiper le futur, de sécuriser les flux et d’automatiser les décisions complexes. Ne vous laissez pas dépasser par le flux des données : apprenez à l’orchestrer pour devenir un leader de la révolution technologique.

Aspirez-vous à maîtriser les rouages des modèles de langage et à concevoir des solutions d’IA ultra-performantes ? Notre formation Data Analyst & AI vous apprend à exploiter l’écosystème Python et le traitement intelligent des flux sémantiques, afin de propulser votre expertise vers les frontières de l’innovation moderne.

Merci pour votre lecture ! Si vous souhaitez découvrir nos prochains articles autour du Deep Learning, de la Data et de l’IA, vous pouvez nous suivre sur Facebook, LinkedIn et Twitter pour être notifié dès la publication d’un nouvel article !